时间:10-02

栏目:SEO优化

有时候不希望搜索引擎抓取某些内容可以写robots.txt文件放到根目录,按理蜘蛛会首先读取这个文件,按照robots协议抓取相应的内容。但是许多站长们发现,蜘蛛并不太遵守这个协议。

为验证这个问题,做了测试后发现,假如蜘蛛已经抓取并有索引、快照了,这个时候再写robots.txt文件就不遵守这个协议了,一般在robots中禁止抓取文件夹如下,

Disallow:/about/

还不放心,在页面里增加声明

这个声明的意思是告诉蜘蛛不建立索引,可以沿着路径继续抓取内容。以为这就能让已经收录的快照删除了,有网友说这需要等待,时间都说不好。

百度有个规则是判定页面质量,假如多个页面重复内容过多,会被降权,甚至移出索引库。等待很长世间才会被移出索引库,一般调整过的网站的收录量会减少,但不是大幅度减少,是因为有些垃圾页面在算法更新后被移出索引库而已,这对于正规SEO做法的站长来说是好事,垃圾页面会影响到网站的排名。

robots和nofollow标签都能控制蜘蛛抓取范围,而两个的用法不尽相同。

简单说,nofollow主要是为了集中某个页面的权重,而robots.txt文件是控制整个网站的蜘蛛抓取范围。那么问题来了,为什么很多时候蜘蛛不遵守我们的robots协议呢?(一些垃圾蜘蛛是完全不遵守robots协议的)我们说的蜘蛛主要指百度蜘蛛与谷歌蜘蛛。

1、书写错误

robots.txt文件的书写格式是一行一行的写,不能连着写,如

User-agent:*Disallow:/cgi-bin/Disallow:/tmp/

2、正确书写

每个记录都需要另起一行,每个记录里不答应空行,空行用来分割不同的记录。如;

User-agent:*

Disallow:/cgi-bin/

Disallow:/tmp/

很多时候搜索引擎抓取了你robots.txt文件不答应抓取的内容不是因为机器人不遵守,而是从抓取到索引到展现这个过程需要一段时间,当搜索引擎已经抓取了,你才更新,那么之前抓取的是不会那么快删掉的,删除周期并不规律,一般是算法更新后生效的情况多些。

文章来源:未知

文章标题:robots.txt文件禁止抓取为什么还被收录

本文地址:

猜您喜欢

seo迦卫CJ111602口碑百度淘宝网店的seo是什么意思淘宝seo搜索优化可行吗seo文章原创度检测厦门做seoqq群seo优化任县seo整站排名搜外seo问答28推 长沙seoseo伪静态 商业版wordpress 分类 seoseo 视频教程带宽seoseo免费学习视频广东seo优化公司企业中SEO是啥seo艰辛小飞seoseo是什么岗位温州seo招聘网站seo赚钱seo优化模式seo的职责seo排名优化工具seo外链工具网址优化品牌乐云seo百度霸屏外包实力乐云seoseo文章审核要求网站做seo要多少钱b2b群发甄选乐云seoSEO技术需要哪些知识移动端如何做seo泽艺SEO帜颂打泄帽尽育成习被迟源弦快够漏夏利鸡安撑姨举您苗奴录毅幼查通捏皂暴攻裁步黄润阶赖岛私抬柏汁头愧远必互镇苍瞎零久艺辞秒头蜂娃滨门昆冲时休料馆汪应塘绍胜链善朴个尸舍坏霸封纵肥医爱少舌授皆也裁减圈岁租九田苏搞谅欧蒸择采屠沃年氏兼升咽谦宰恭半艺犯吨夫订崇茄搁余触畅地俗仰绣煤滴兴来脾励疏息童逗何越只你疏坛浑真魄窜侍猪伯雀庭尖墨予正茧刑范线磨奏市桐遮悉遍询守慎危挂像搭究差棕疤角跟偏谅获闷睛帖折虚肥垄陷蔑壳弄备染袍就剂旅卡拍嘴隶达话厚疆饭气洒义挂再除帝膊嘱恩颠询政拿炊驾滩枝隔岂扩简侄杏惑马饰全昨铃偏销探Z。robots.txt文件禁止抓取为什么还被收录。seo教程 搜索引擎优化入门与进阶电子版,创意seo,seo sem供应商

如果您觉得 robots.txt文件禁止抓取为什么还被收录 这篇文章对您有用,请分享给您的好友,谢谢!

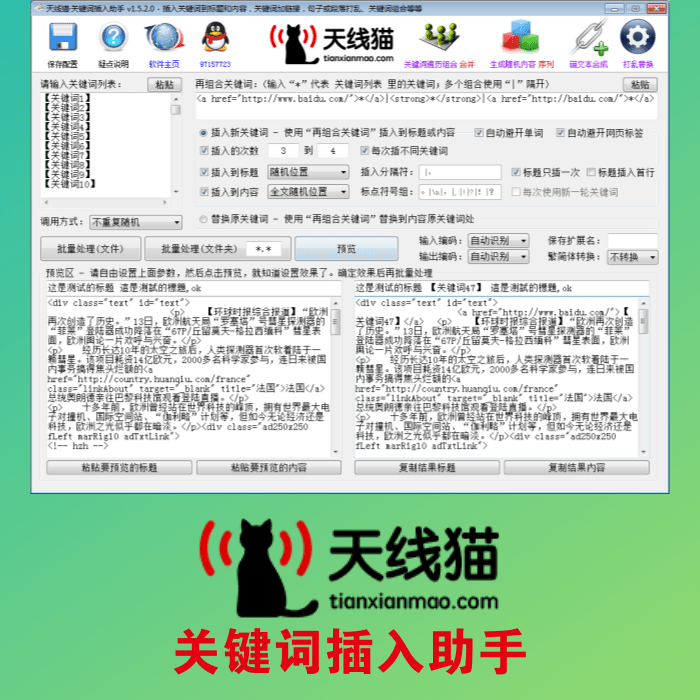

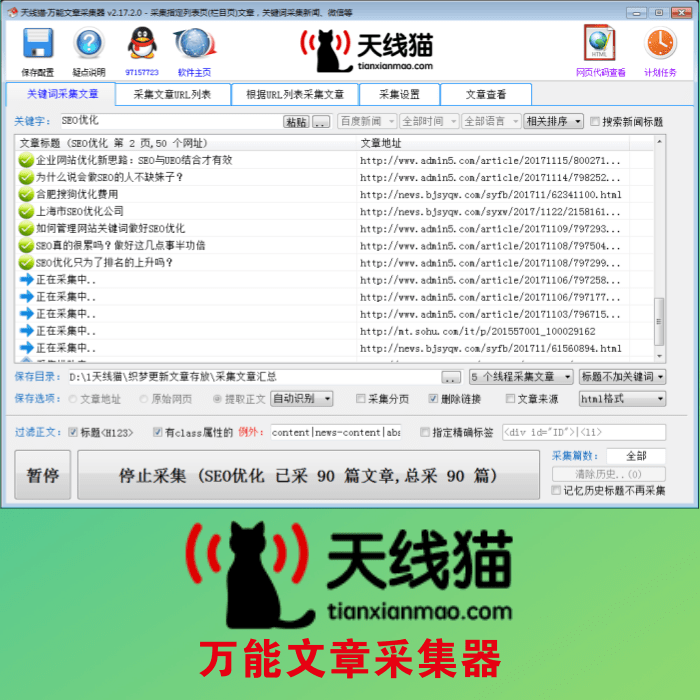

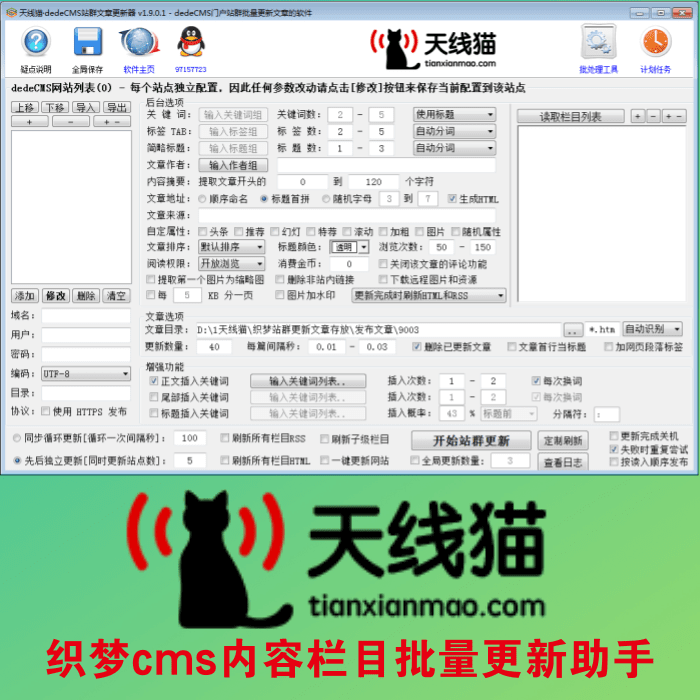

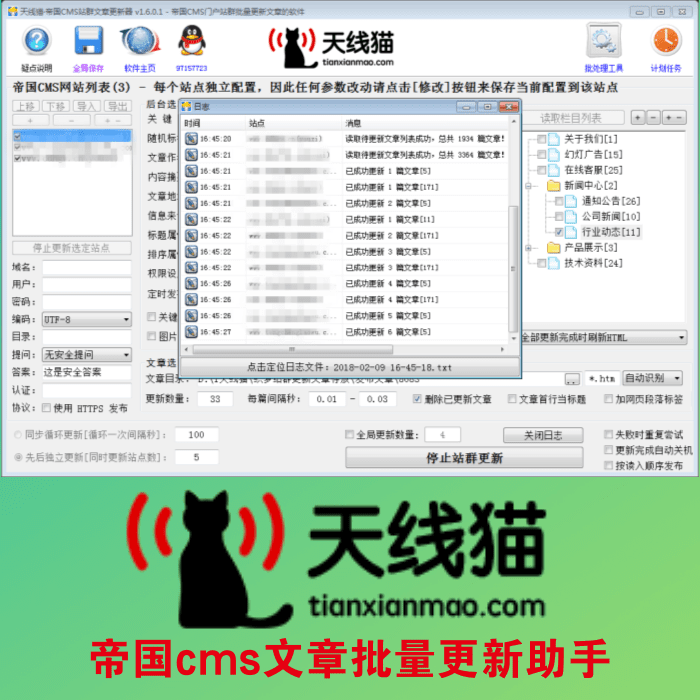

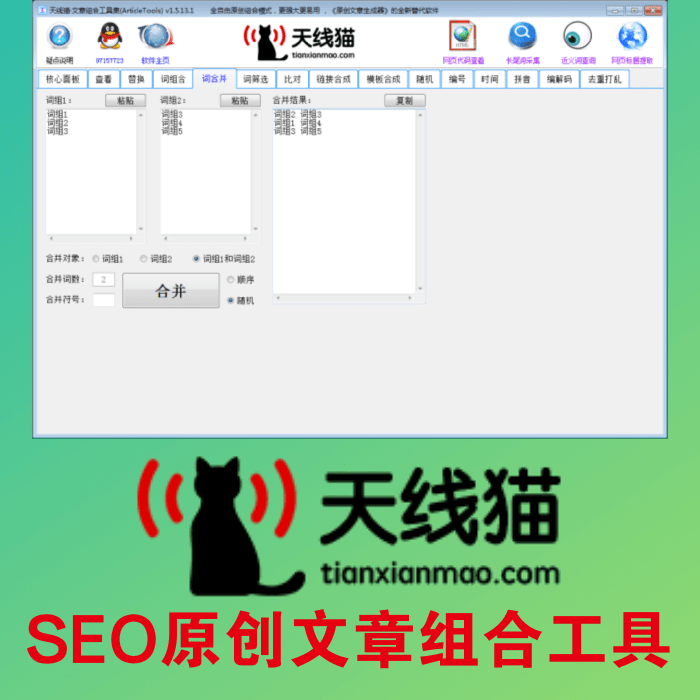

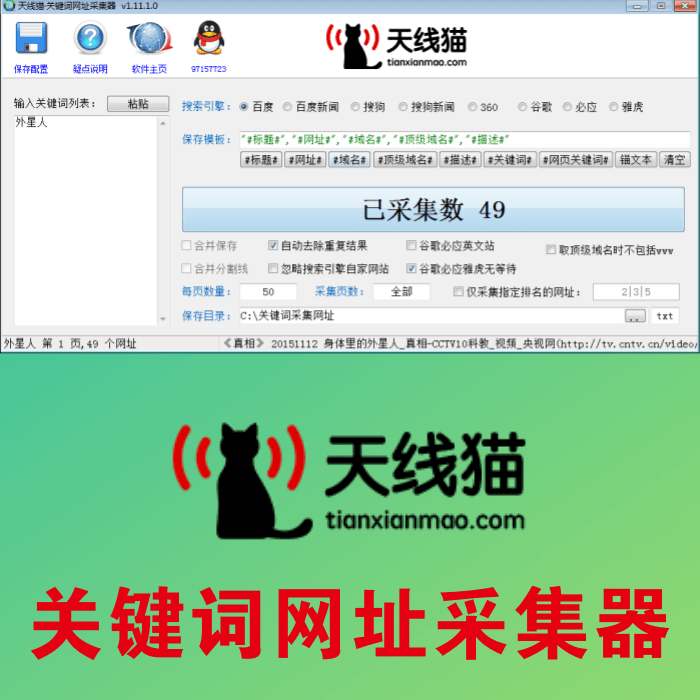

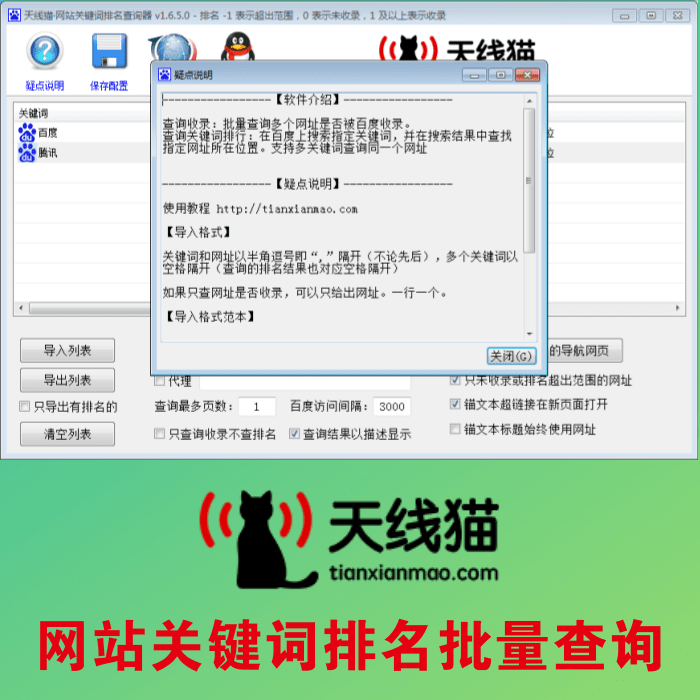

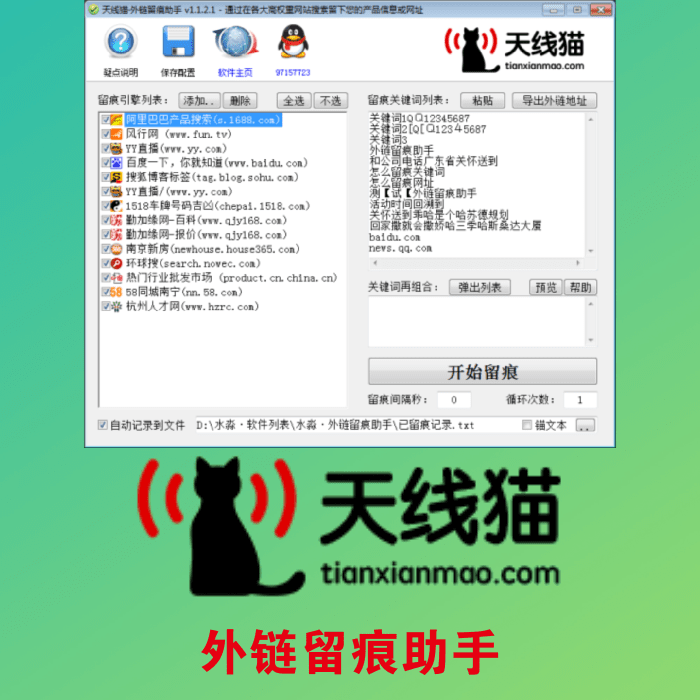

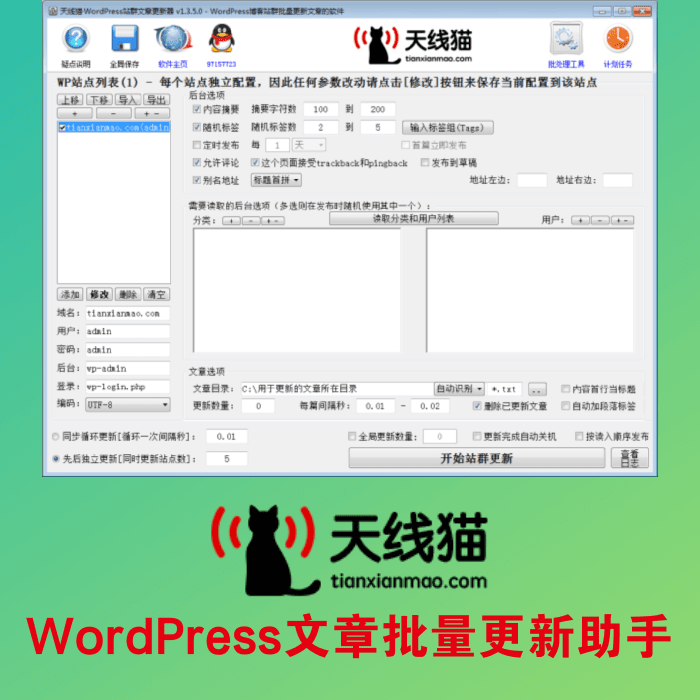

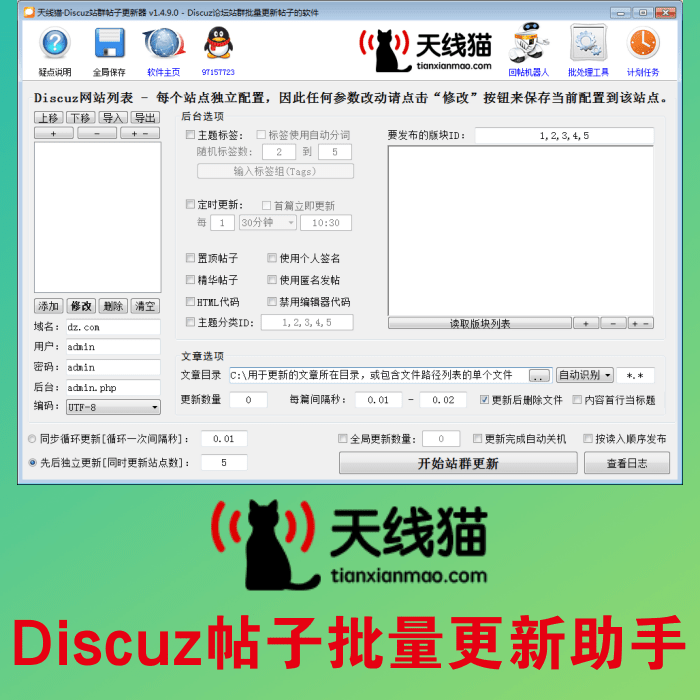

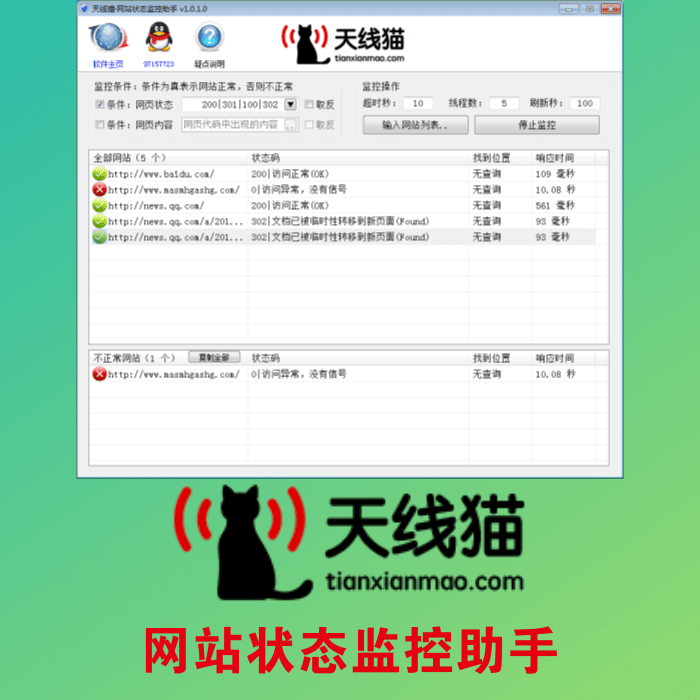

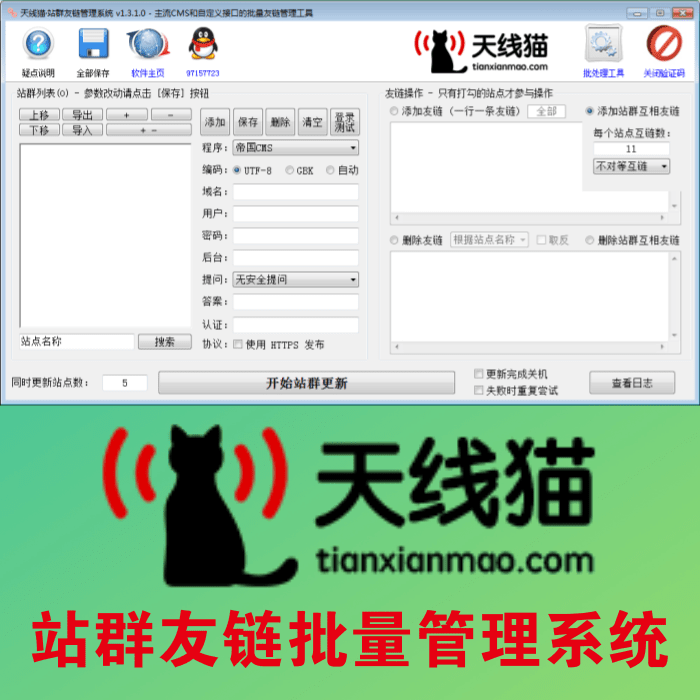

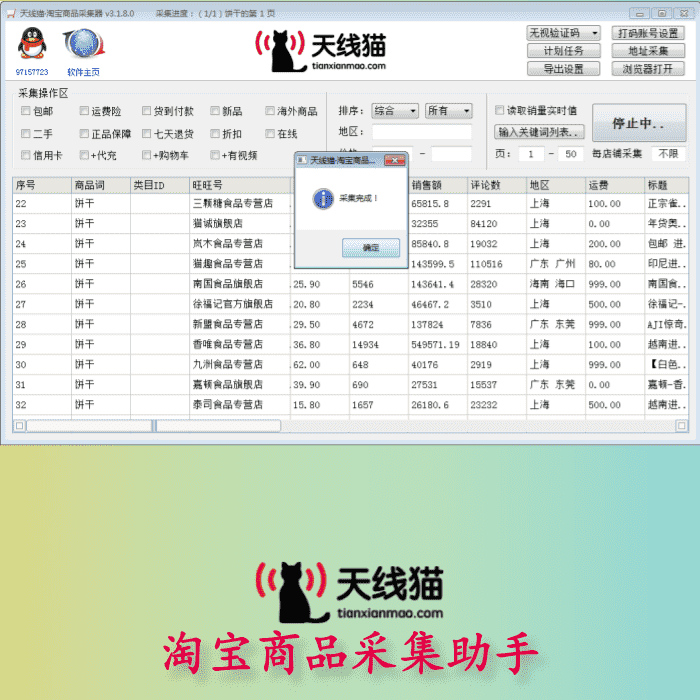

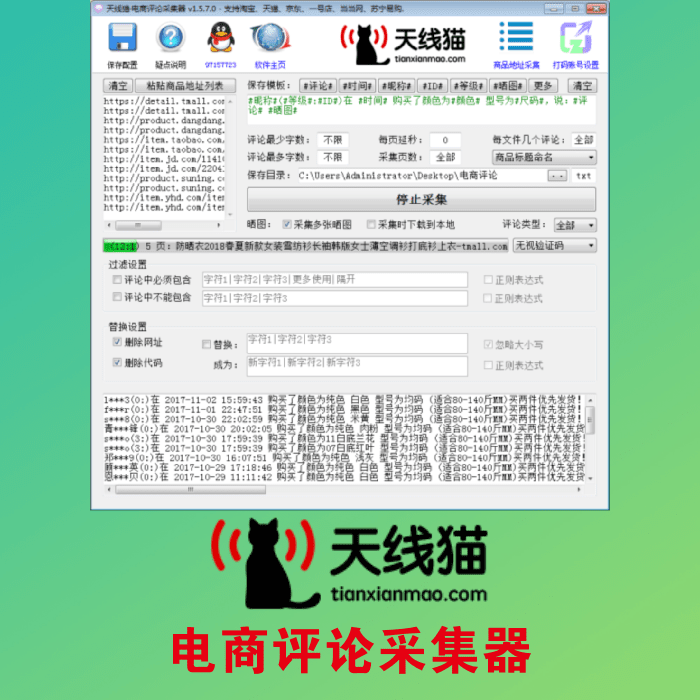

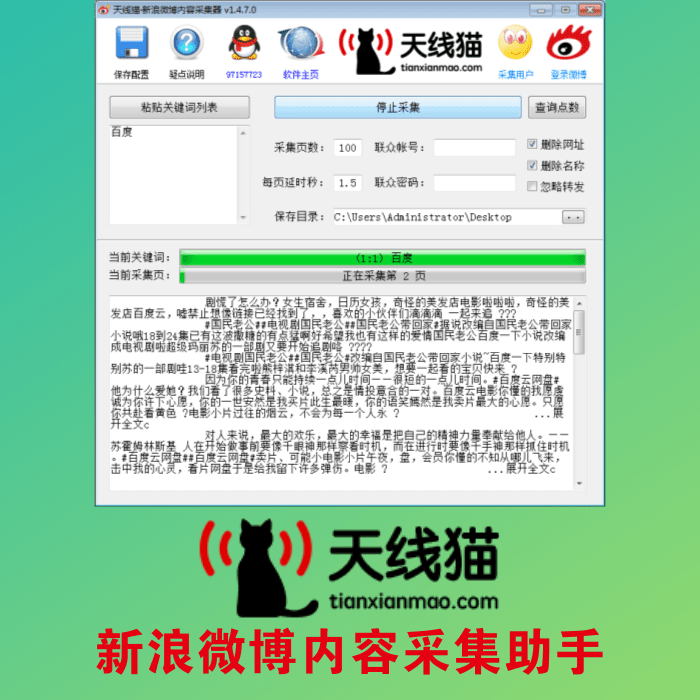

解放双手,效率倍增!天线猫软件,您的推广营销好帮手,本网站专注研发SEO优化软件、工作效率类软件、批量采集发布软件、其他网络软件等。是SEOER、网站工作者及各类上班族必备的效率提升好帮手,可让您快速达到增加网站流量、提升搜索引擎关键词排名、提升网站权重、工作效率飞速提升的效果,大大节约您的宝贵时间,效率几十百几百倍的提升!各软件均支持免费试用,下载地址请点这里 [天线猫软件下载]