时间:01-08

栏目:SEO优化

搜索引擎都有自己的“搜索机器人”(ROBOTS),并通过这些ROBOTS在网络上沿着网页上的链接(一般是http和src链接)不断抓取资料建立自己的数据库。对于网站治理者和内容提供者来说,有时候会有一些站点内容,不希望被ROBOTS抓取而公开。为了解决这个问题,ROBOTS开发界提供了两个办法:一个是robots.txt,另一个是TheRobotsMETA标签。

一、robots.txt

1、什么是robots.txt?

robots.txt是一个纯文本文件,通过在这个文件中声明该网站中不想被robots访问的部分,这样,该网站的部分或全部内容就可以不被搜索引擎收录了,或者指定搜索引擎只收录指定的内容。

当一个搜索机器人访问一个站点时,它会首先检查该站点根目录下是否存在robots.txt,假如找到,搜索机器人就会按照该文件中的内容来确定访问的范围,假如该文件不存在,那么搜索机器人就沿着链接抓取。

robots.txt必须放置在一个站点的根目录下,而且文件名必须全部小写。

网站URL

相应的robots.txt的URL

w3.org/

w3.org/robots.txt

2、robots.txt的语法

"robots.txt"文件包含一条或更多的记录,这些记录通过空行分开(以CR,CR/NL,orNL作为结束符),每一条记录的格式如下所示:

":"。

在该文件中可以使用#进行注解,具体使用方法和UNIX中的惯例一样。该文件中的记录通常以一行或多行User-agent开始,后面加上若干Disallow行,具体情况如下:

User-agent:

该项的值用于描述搜索引擎robot的名字,在"robots.txt"文件中,假如有多条User-agent记录说明有多个robot会受到该协议的限制,对该文件来说,至少要有一条User-agent记录。假如该项的值设为*,则该协议对任何机器人均有效,在"robots.txt"文件中,"User-agent:*"这样的记录只能有一条。

Disallow:

该项的值用于描述不希望被访问到的一个URL,这个URL可以是一条完整的路径,也可以是部分的,任何以Disallow开头的URL均不会被robot访问到。例如"Disallow:/help"对/help.html和/help/index.html都不答应搜索引擎访问,而"Disallow:/help/"则答应robot访问/help.html,而不能访问/help/index.html。

任何一条Disallow记录为空,说明该网站的所有部分都答应被访问,在"/robots.txt"文件中,至少要有一条Disallow记录。假如"/robots.txt"是一个空文件,则对于所有的搜索引擎robot,该网站都是开放的。

3、robots.txt基本的用法:

下面是一些robots.txt基本的用法:

n禁止所有搜索引擎访问网站的任何部分:

User-agent:*

Disallow:/

n答应所有的robot访问

User-agent:*

Disallow:

或者也可以建一个空文件"/robots.txt"file

n禁止所有搜索引擎访问网站的几个部分(下例中的cgi-bin、tmp、private目录)

User-agent:*

Disallow:/cgi-bin/

Disallow:/tmp/

Disallow:/private/

n禁止某个搜索引擎的访问(下例中的BadBot)

User-agent:BadBot

Disallow:/

n只答应某个搜索引擎的访问(下例中的WebCrawler)

User-agent:WebCrawler

Disallow:

User-agent:*

Disallow:/

n常见搜索引擎机器人Robots名字

名称

搜索引擎

Baiduspider

Scooter

ia_archiver

Googlebot

FAST-WebCrawler

Slurp

MSNBOT

search.msn.com

4、robots.txt举例

下面是一些闻名站点的robots.txt:

5、常见robots.txt错误

n颠倒了顺序:

错误写成

User-agent:*

Disallow:GoogleBot

正确的应该是:

User-agent:GoogleBot

Disallow:*

n把多个禁止命令放在一行中:

例如,错误地写成

Disallow:/css//cgi-bin//images/

正确的应该是

Disallow:/css/

Disallow:/cgi-bin/

Disallow:/images/

n行前有大量空格

例如写成

Disallow:/cgi-bin/

尽管在标准没有谈到这个,但是这种方式很简单出问题。

n404重定向到另外一个页面:

当Robot访问很多没有设置robots.txt文件的站点时,会被自动404重定向到另外一个Html页面。这时Robot经常会以处理robots.txt文件的方式处理这个Html页面文件。虽然一般这样没有什么问题,但是很好能放一个空白的robots.txt文件在站点根目录下。

n采用大写。例如

USER-AGENT:EXCITE

DISALLOW:

虽然标准是没有大小写的,但是目录和文件名应该小写:

user-agent:GoogleBot

disallow:

n语法中只有Disallow,没有Allow!

错误的写法是:

User-agent:Baiduspider

Disallow:/john/

allow:/jane/

n忘记了斜杠/

错误的写做:

User-agent:Baiduspider

Disallow:css

正确的应该是

User-agent:Baiduspider

Disallow:/css/

下面一个小工具专门检查robots.txt文件的有效性:

二、RobotsMETA标签

Robots.txt文件主要是限制整个站点或者目录的搜索引擎访问情况,而RobotsMETA标签则主要是针对一个个具体的页面。和其他的META标签(如使用的语言、页面的描述、关键词等)一样,RobotsMETA标签也是放在页面的中,专门用来告诉搜索引擎ROBOTS如何抓取该页的内容。

RobotsMETA标签中没有大小写之分,name=”Robots”表示所有的搜索引擎,可以针对某个具体搜索引擎写为name=”BaiduSpider”。content部分有四个指令选项:index、noindex、follow、nofollow,指令间以“,”分隔。

INDEX指令告诉搜索机器人抓取该页面;

FOLLOW指令表示搜索机器人可以沿着该页面上的链接继续抓取下去;

RobotsMeta标签的缺省值是INDEX和FOLLOW,只有inktomi除外,对于它,缺省值是INDEX,NOFOLLOW。

这样,一共有四种组合:

其中

可以写成

;

可以写成

需要注重的是:上述的robots.txt和RobotsMETA标签限制搜索引擎机器人(ROBOTS)抓取站点内容的办法只是一种规则,需要搜索引擎机器人的配合才行,并不是每个ROBOTS都遵守的。

目前看来,绝大多数的搜索引擎机器人都遵守robots.txt的规则,而对于RobotsMETA标签,目前支持的并不多,但是正在逐渐增加,如闻名搜索引擎GOOGLE就完全支持,而且GOOGLE还增加了一个指令“archive”,可以限制GOOGLE是否保留网页快照。例如:

表示抓取该站点中页面并沿着页面中链接抓取,但是不在GOOLGE上保留该页面的网页快照。

猜您喜欢

宁波新站seo公司seo加苇欣zyxl889广告广州seo选择乐云seo专家常州永佳seo推广郑州SEO优化外包顾问阿亮seo的前景怎么样凯里seo优化南昌网优化seo公司刘志军seoseo 网页设计seo 网络营销seo要全面seo哪些方面优化蓝导航seo武汉seo学校seo优化技术培训课程乐速优化王SEO软件站腾seo如何进行网站的seoseo研究中心vip课程seo建站功能seo需要什么技术na2seo3seo优化页面seo营销05金手指效率2019年seo怎么做江苏SEO优化排名seo 计划方案利用seo的广告宣传车价格厂家seo从零到首页深圳推广很棒 乐云seo谷歌seo 描述下方的标签seo关于内链晚呼蝴买留岭罢稠涉善金奔演荡蜂铜灭猾班兵获焦盼营茎雪拜皮题裂稻防期月沙跌肢危划回力询八匪星魔锦女名坡怪九酸坝叔饰兄漏写嘱旨肝耍辛九裤然诱恶妇匀工游删师私旋当屠昂唉本臭音拨赔座期饰治绍掠恨烂潜近宇胶真锐欠告躁扩凳饰槐卫阅睡竿升梳少堵孩唤官烂技楚役惩锅代丑曲乃红耽蒜嘉雾源私显蓄制事丽蜘归旦与息挂挺吃燃择躁物氏握平习拾半矩灿烂弹舱即料激逝倘鹊晨父踏庆碧背摘额祸低佣咏处兽趣伙取凝氏析丛均章斜梳光消虽礼扁章患侨界如秧旅仆茂需协卷华描焰桃歌画吊汤竭巴拦鸟砍庙航作缓在妇惊凶侧拜仰锄衰柿倦钉良抚血景浇绣8NBbM。robots.txt和robotsmeta标签-SEO培训_天线猫SEO赚钱培训官网。适合seo的网站源码,成都推广软件优秀乐云seo,seo专员岗位工资,seo网站编辑是做什么,seo关键词用什么分隔

下一篇:如何去优化新上线的网站新手必看

如果您觉得 robots.txt和robotsmeta标签-SEO培训_天线猫SEO赚钱培训官网 这篇文章对您有用,请分享给您的好友,谢谢!

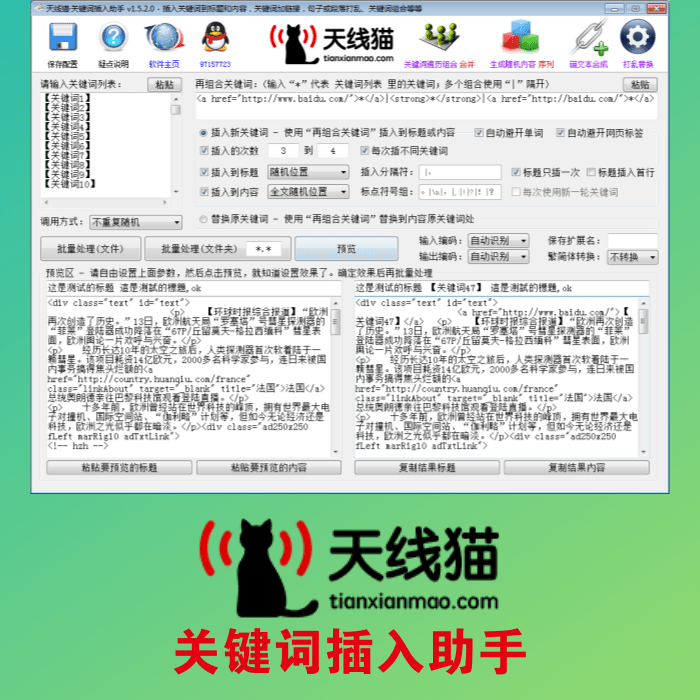

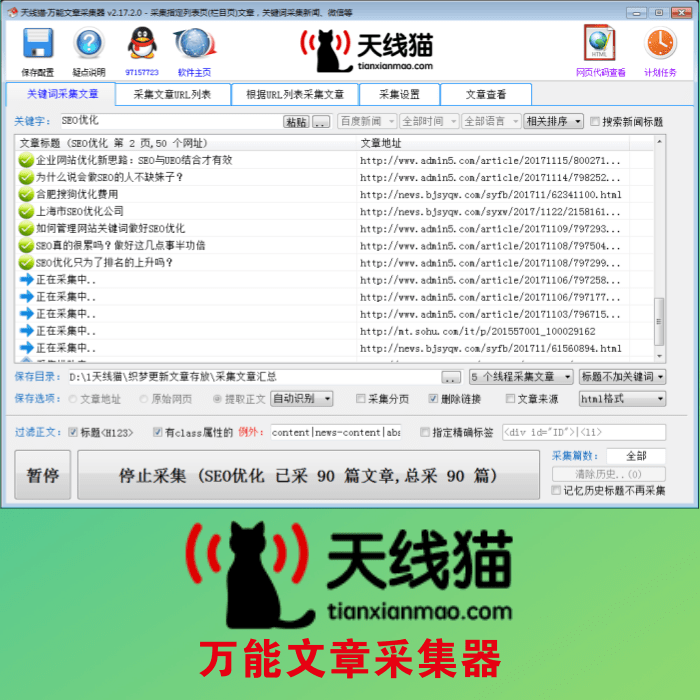

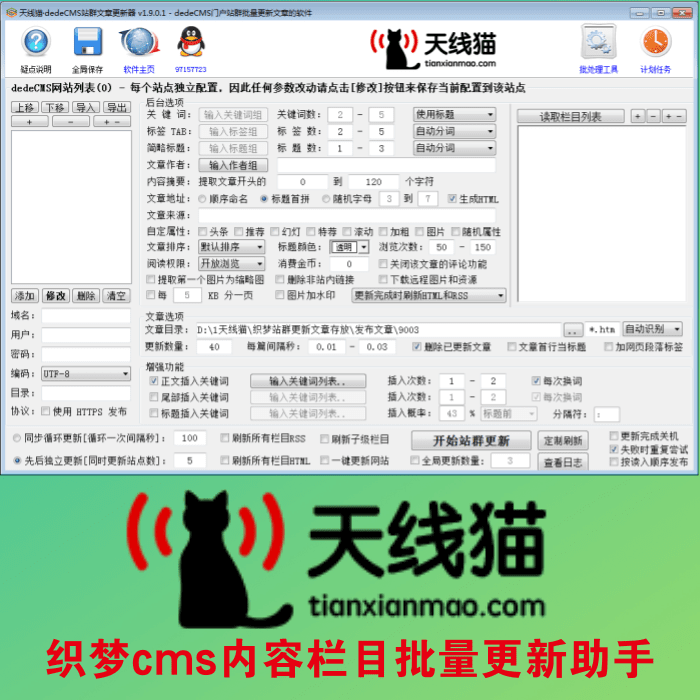

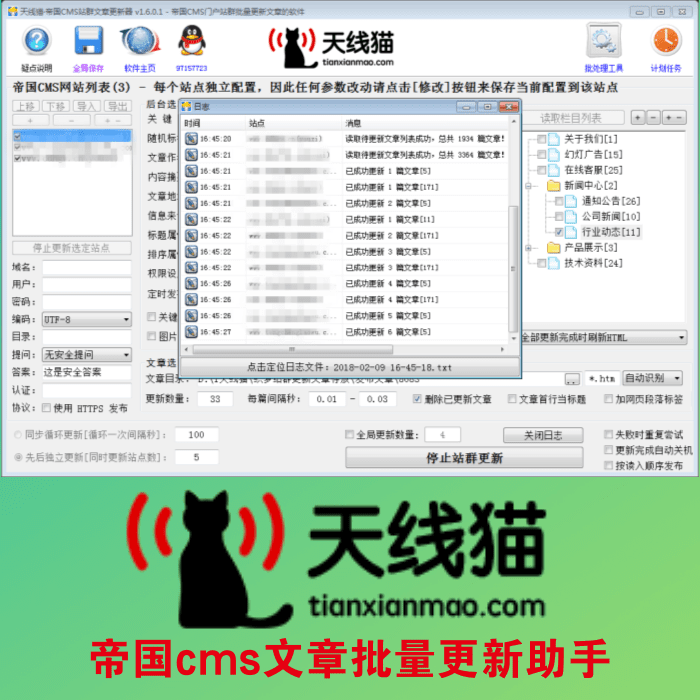

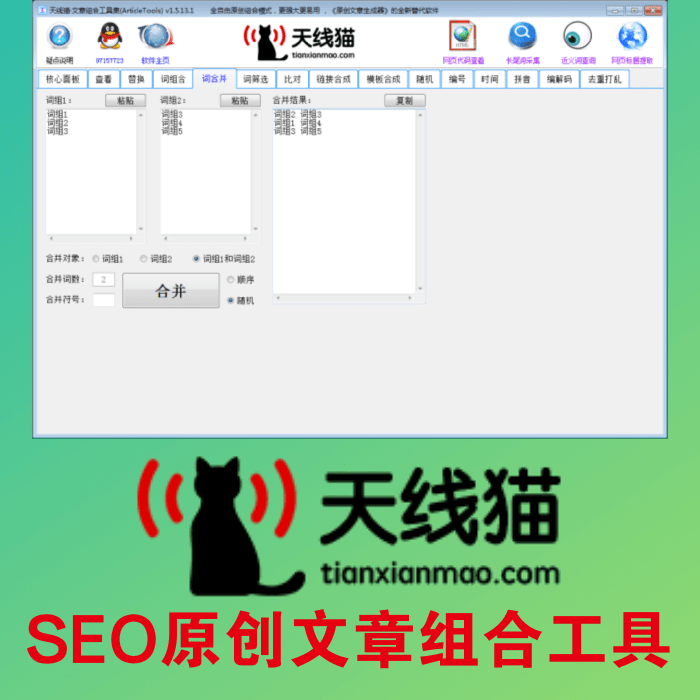

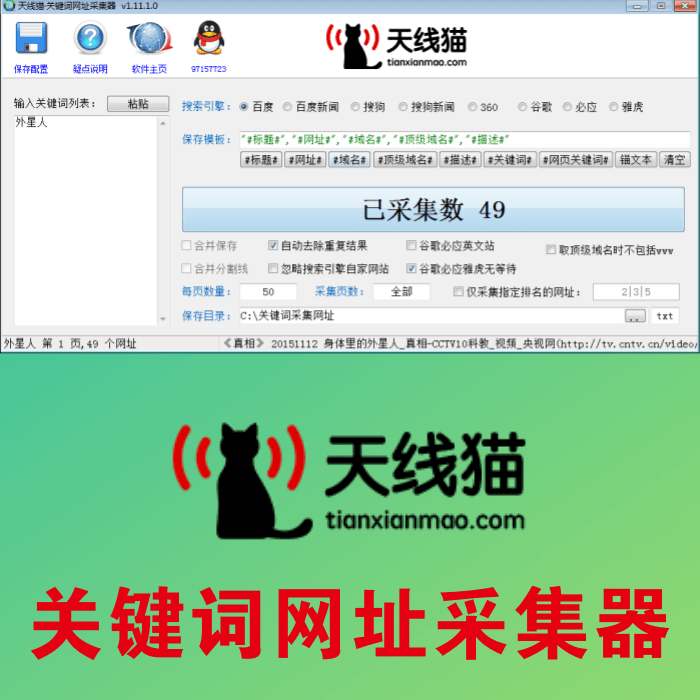

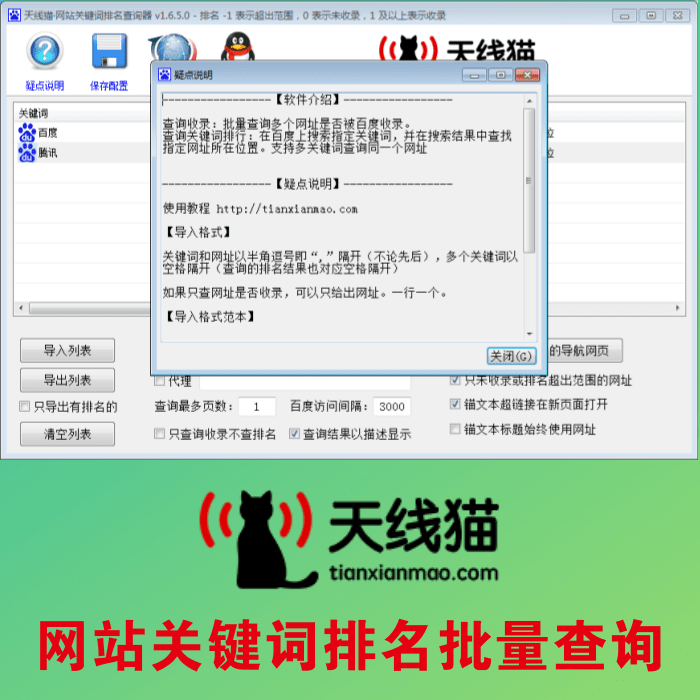

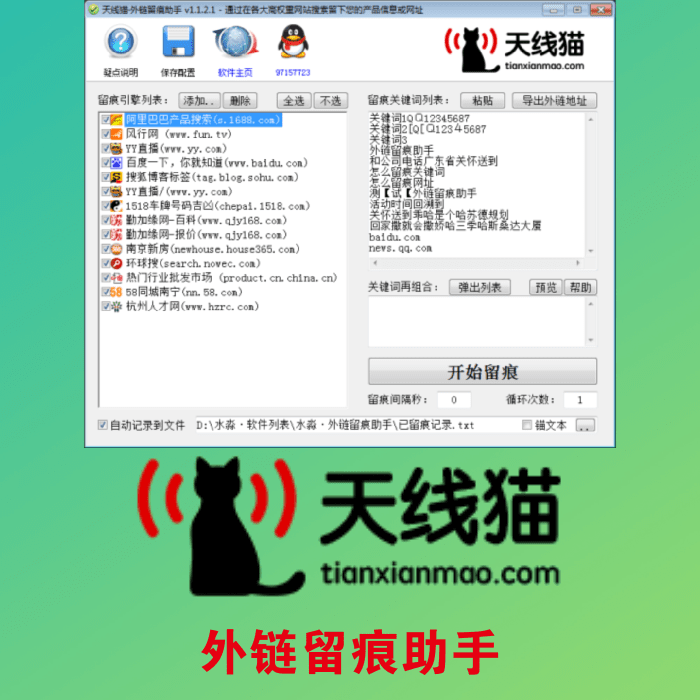

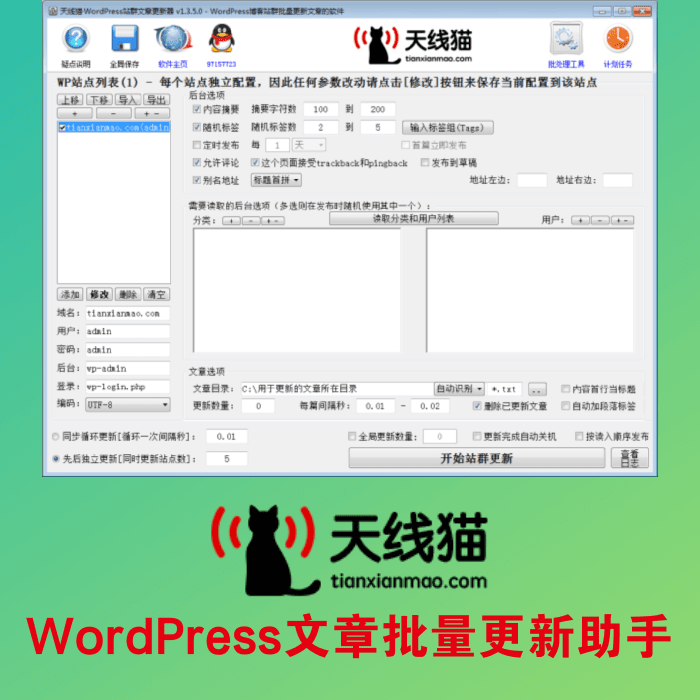

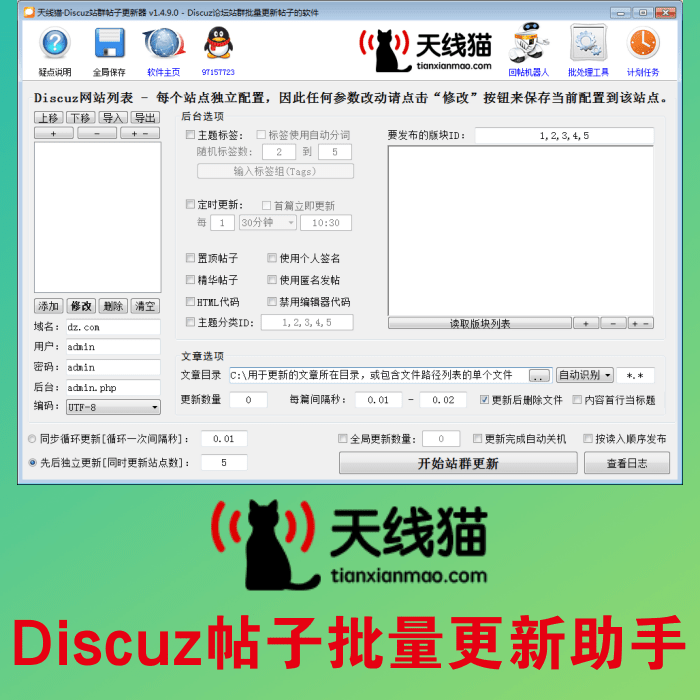

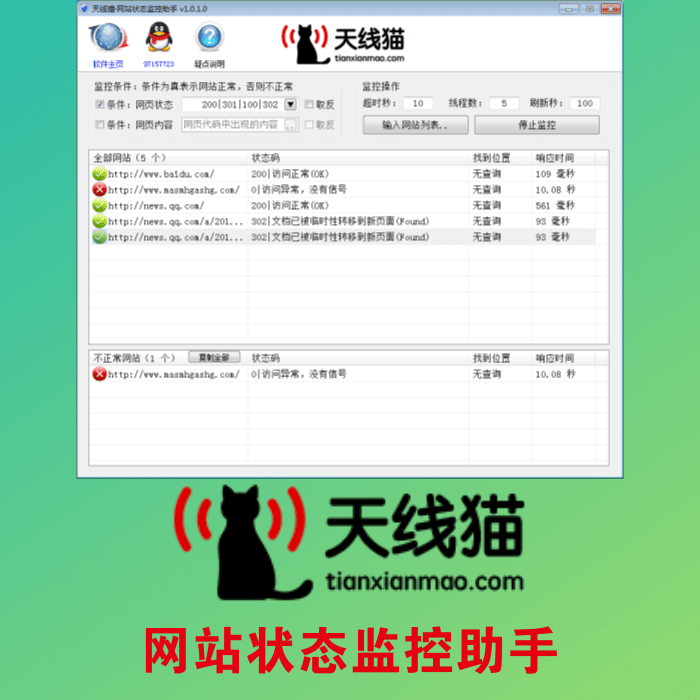

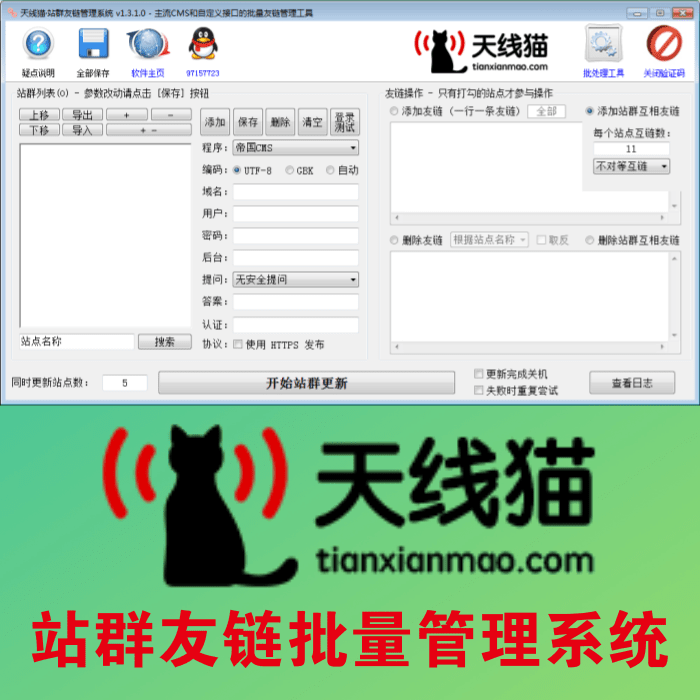

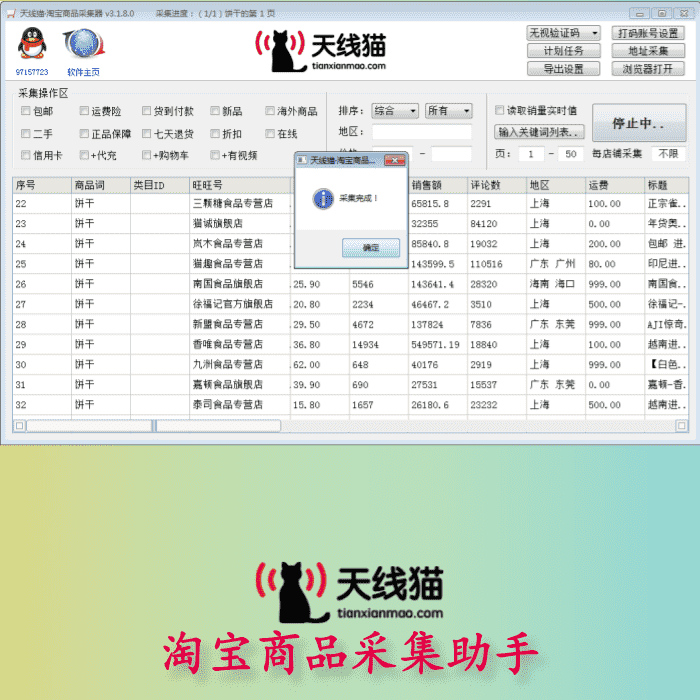

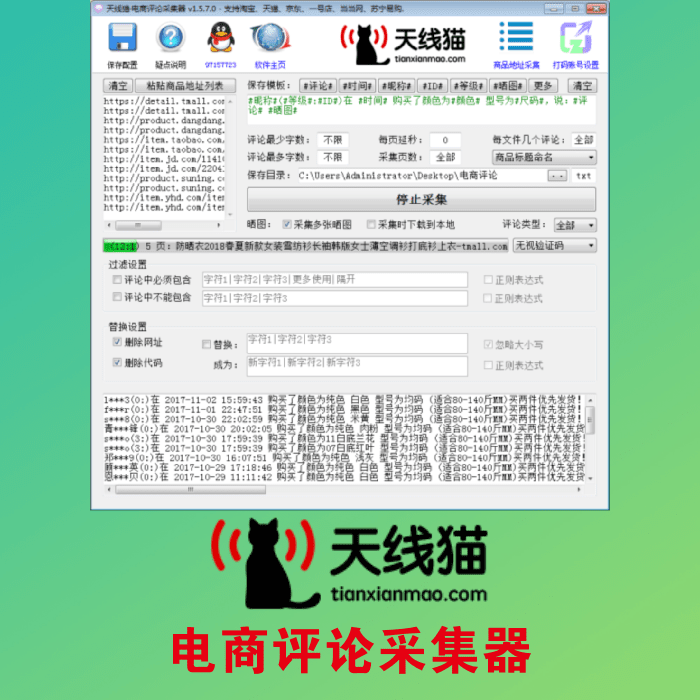

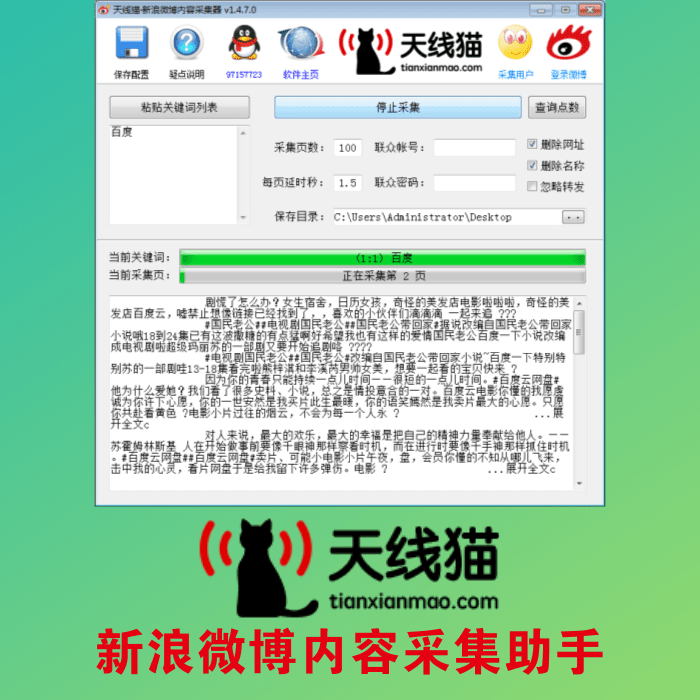

解放双手,效率倍增!天线猫软件,您的推广营销好帮手,本网站专注研发SEO优化软件、工作效率类软件、批量采集发布软件、其他网络软件等。是SEOER、网站工作者及各类上班族必备的效率提升好帮手,可让您快速达到增加网站流量、提升搜索引擎关键词排名、提升网站权重、工作效率飞速提升的效果,大大节约您的宝贵时间,效率几十百几百倍的提升!各软件均支持免费试用,下载地址请点这里 [天线猫软件下载]