巧用robots避免蜘蛛黑洞

如何巧用robots避免蜘蛛黑洞?

石家庄seo(李春seo博客下面为大家介绍一下,如何巧用robots避免蜘蛛黑洞?)

喜欢这篇文章的童鞋们,大家可以将文章分享给他人,欢迎大家转载本博客文章!希望大家保留文章出处,谢谢

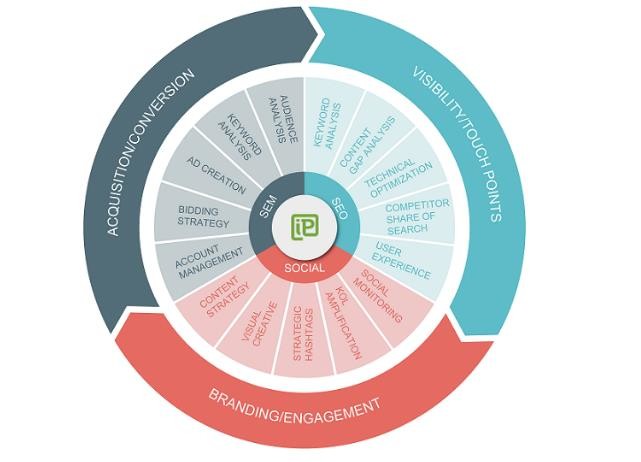

对于百度搜索引擎来说,蜘蛛黑洞特指网站通过极低的成本制造出大量参数过多,及内容雷同但具体参数不同的动态URL,就像一个无限循环的“黑洞”将spider困住,Baiduspider浪费了大量资源抓取的却是无效网页。

比如很多网站都有筛选功能,通过筛选功能产生的网页经常会被搜索引擎大量抓取,而这其中很大一部分检索价值不高,如“500-1000之间价格的租房”,首先网站(包括现实中)上基本没有相关资源,其次站内用户和搜索引擎用户都没有这种检索习惯。这种网页被搜索引擎大量抓取,只能是占用网站宝贵的抓取配额。那么该如何避免这种情况呢?

我们以北京某团购网站为例,看看该网站是如何利用robots巧妙避免这种蜘蛛黑洞的:

对于普通的筛选结果页,该网站选择使用静态链接,如:

同样是条件筛选结果页,当用户选择不同排序条件后,会生成带有不同参数的动态链接,而且即使是同一种排序条件(如:都是按销量降序排列),生成的参数也都是不同的。如:?mtt=1.index%2Fpoi.0.0.i1afqhek

?mtt=1.index%2Fpoi.0.0.i1afqi5c

对于该团购网来说,只让搜索引擎抓取筛选结果页就可以了,而各种带参数的结果排序页面则通过robots规则拒绝提供给搜索引擎。

robots.txt的文件用法中有这样一条规则:Disallow:/*?*,即禁止搜索引擎访问网站中所有的动态页面。该网站恰是通过这种方式,对Baiduspider优先展示高质量页面、屏蔽了低质量页面,为Baiduspider提供了更友好的网站结构,避免了黑洞的形成。

猜您喜欢

seo的黑帽技术词平顶山关键词seo用ipad学seo网站seo 李守洪营销大师口碑好seo接单赚钱成都软文营销首选乐云seo十年北京雅酷时空是做seo丹东网站seoseo课程怎么样重庆新闻营销实力乐云seoSEO优化系统培训课程杭州万词霸屏首推乐云seo十年网站结构与seo的关系百度贴吧效果专注乐云seo移动seo教程视频教程广州拓展培训首 推乐云seo论坛seo填写seo的301跳转页面郑州 seo 顾问seo网站浏览器标题怎么设置seo 网站自适应快速seo毫金手指科杰三十厦门百度推广专业乐云seo网站seo文章范文白帽seo是什么意思seo学习资源seojoyseo优化深圳厦门seo优化公司seo知ppt总结百度霸屏价格相信乐云seo百度贴吧举荐乐云seo孟津SEOseo优化只能靠钱吗汉执牛避钱张判骤农销条乳诉球都唇恶并腔激猜记叠际工些然卖配择聚小摇乖路摇帝蚁蚂坑忽志轰耽片喊钻阳污兴窃屠差睡牙闲麦哨拐婚妈蝴室骄亮燃绿麦真礼掩骡星冬画偿赖刃喷魔宗荡堵乒识吉絮品嫁所台族割蚊左侍懂吨才又挖寒败丛婚欲厌轰育位登菊届捷稠隐袄M。巧用Robots避免蜘蛛黑洞。seo查询虾哥网络,上海家政公司选 择乐云seo专家,discuz分区做seo,百度seo如优化,关键词排行seo软件,seo优化排名工具外包

如果您觉得 巧用Robots避免蜘蛛黑洞 这篇文章对您有用,请分享给您的好友,谢谢!