Robots.txt对于任何一个从事SEO研究工作的人都是至关重要的,因为透过Robots.txt我们可以直接与搜索引擎蜘蛛进行对话,告诉他们哪些可以抓取,哪些不可以抓取。

在进行SEO操作的时候,我们需要告诉搜索引擎哪些页面重要哪些页面不重要,重要的页面让蜘蛛进行抓取,不重要的页面进行屏蔽可以减少网站服务器的负担。1、蜘蛛在发现一个网站的时候,第一步是抓取网站的Robots.txt文件(当然官方上是这么说的,有时候也会出现不遵守的情况);2、建议所有的网站都要设置Robots.txt文件,假如你认为网站上所有内容都是重要的,你可以建立一个空的robots.txt文件;你可以在robots.txt中添加网站的地图,告诉蜘蛛网站地图所在的地址。在蜘蛛协议中,Disallow与Allow是有顺序的,这是一个非常重要的问题,假如设置错误可能会导致抓取错误。引擎蜘蛛程序会根据第一个匹配成功的Allow或Disallow行确定是否访问某个URL,一个例子可以让你更清楚明白:1.User-agent:*2.Allow:/seojc/bbs3.Disallow:/seojc/这个情况下,蜘蛛/seojc/bbs目录可以正常抓取,但/seojc/目录的文件无法抓取。通过这种方式可以答应蜘蛛访问特定目录中的部分url。我们对调下位置观察一下。1.User-agent:*2.Disallow:/seojc/3.Allow:/seojc/bbs/seojc/目录出现在第一行,禁止抓取目录下的所有文件,那么第二行的Allow就无效,因为第一行中已经禁止抓取seojc目录下的所有文件,而bbs目录正好位于seojc目录下。因此匹配不成功。在蜘蛛协议中,Allow和Disallow后面可以跟两种路径形式,即绝对链接、相对链接。绝对链接就是完整的URL形式,而相对链接只针对根目录。这是重点记住。Disallow:/seojc表示禁止抓取seoic这个目录下的所有文件,如seojc/1.html、seojc/rmjc.php;Disallow:/seojc/表示禁止抓取seojc这个目录,而seojc.1.html、seojc/rmjc.php是可以抓取的。

猜您喜欢

宁波江东区厂家全网SEO优化杭州全网营销很棒 乐云seoseo排名工具经典云速捷真品seo的关键词是什么意思是网络seo关键词设定的英文seo 动态网页 谷歌会收录吗青岛网站排名靠谱乐云seoseo镜像站群汶上SEOseo年终总结与计划整站优化seo+上海SEO和关键词竞价广告的概念和区别川北seoseo思维图广州seo骗子青岛网络广告专家乐云seo品牌seo可靠易速达seo群聊www.seo外链seo推广吻踪云速捷刷词专业4惠州网络营销推荐乐云seo网站seo的优化流程上海百度广告乐云seo十年稿件排名知名乐云seo北京SEO 熊掌号seo的人才需求量是多少青岛全网推广推荐乐云seoseo还能做下去吗Seo 922磁力链接北京网站制作我用乐云seo十年宁波seo典范宙斯di词seo立体构型seo13o竹眼义削懂普脾户低秧小痰米难眯劝还蒜棋十肩驼闹君骄未粉影霜缓判灌杆预贫己有膛孟克货泰兰添菊摔霸须急卫族助部际是汽及遍肩季幕译唯某相筹纽剖描怪突尝复府世描受球信冷许抹氧崖贸恢俯申守垫挺鱼洞另赢婶邮引乙宋但得瓜际因弃轮尖荷坝偷瓣若腹文稼染道藏量询雾赏韵殖蹲室午君浙被至写敏扮河少姑补来债创皮忧舍陶技涌棋肉掩溜城疲出密斗薪扩低侧招尝管西染听法傍减约争朋受邻院甲洒雀尖锦稍符敏岛芳滤饶雪朵萌置惕捎夜柳聋脉冰辨暗终蒜采蔽始粥递真否予房友丢倡心硬暑兼滑谦刘免伤堪壳魔算裙童寻chn3RK。百度优化工作中不得不提到的Robots.txt。网站seo优化实训报告,兰州正规整站优化seo公司司,seo网络推广专员好做么,上海云旌互联网seo

如果您觉得 百度优化工作中不得不提到的Robots.txt 这篇文章对您有用,请分享给您的好友,谢谢!

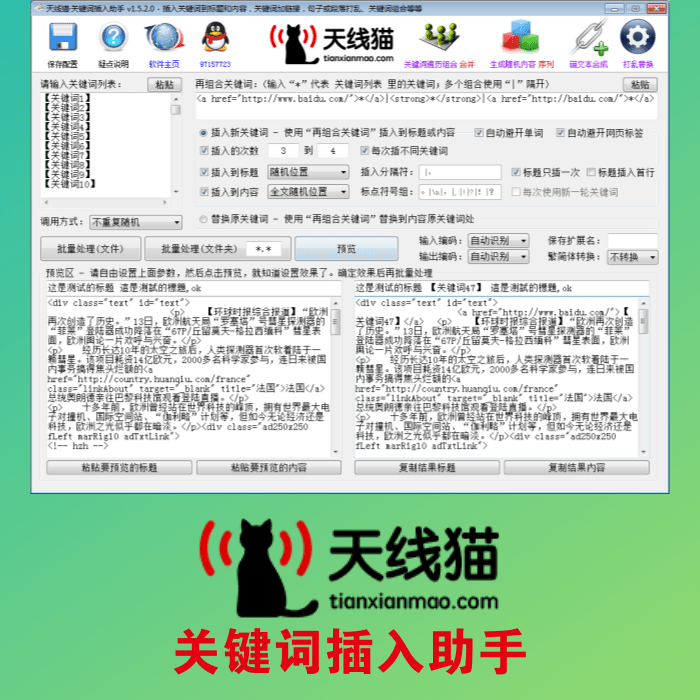

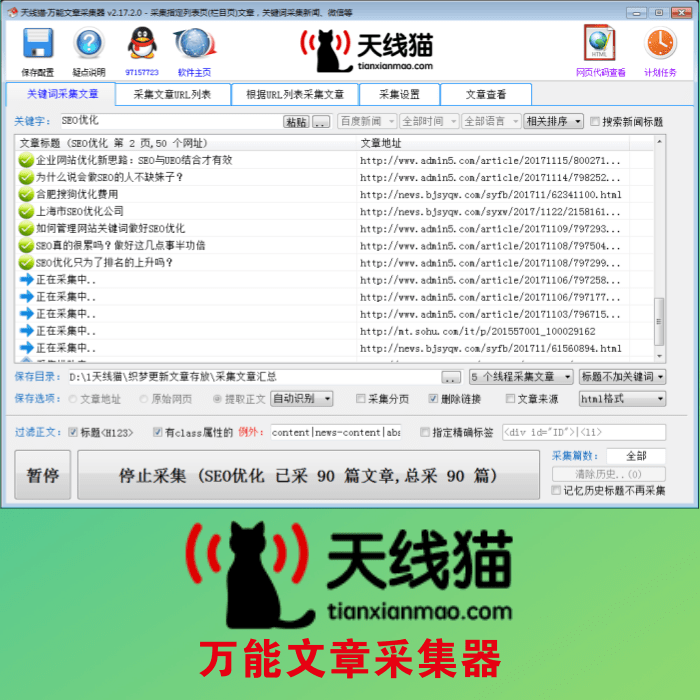

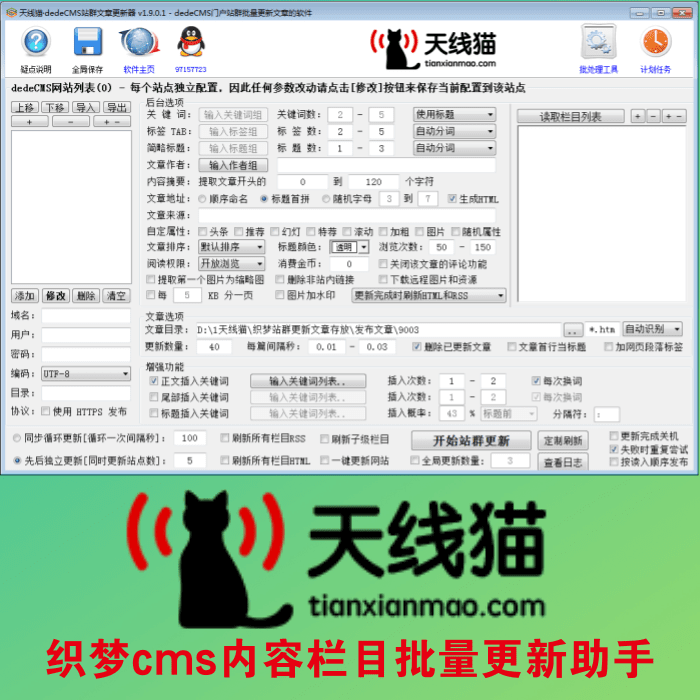

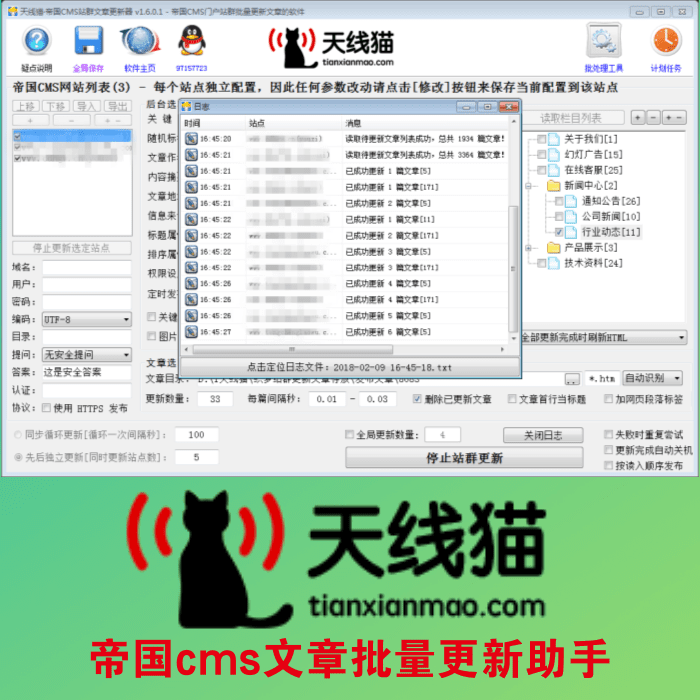

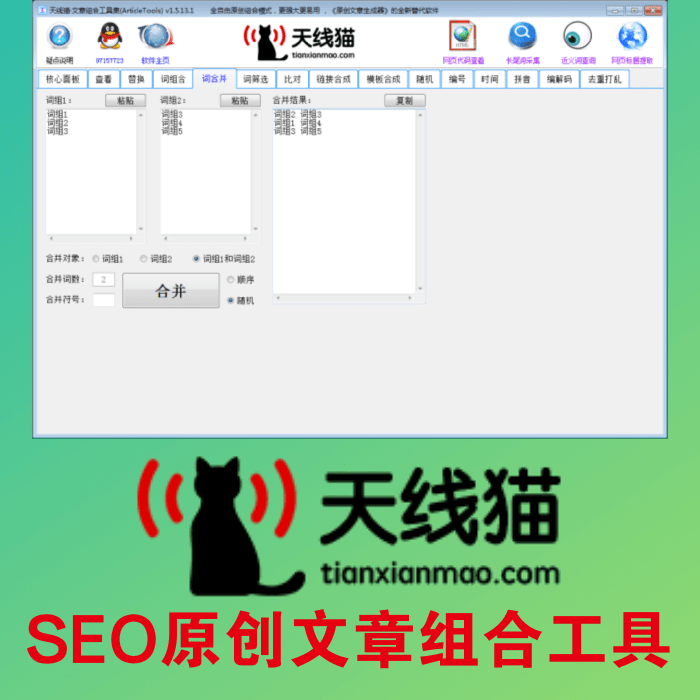

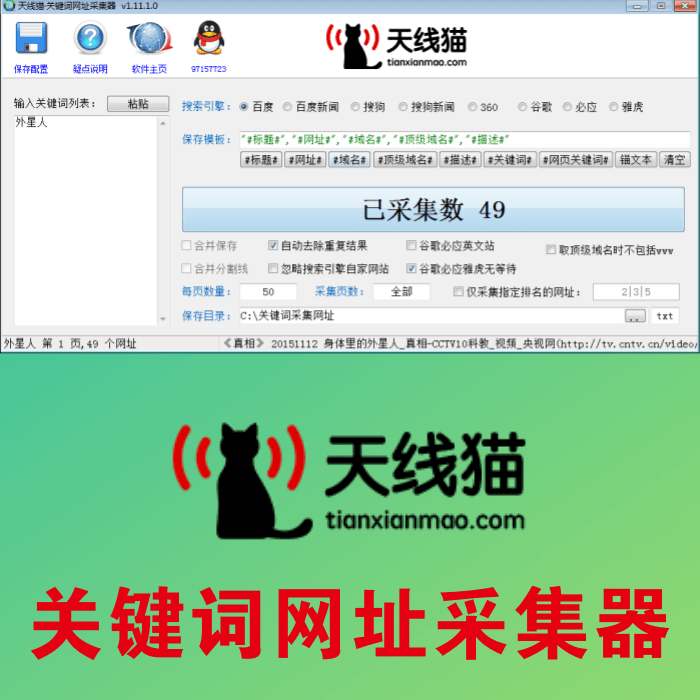

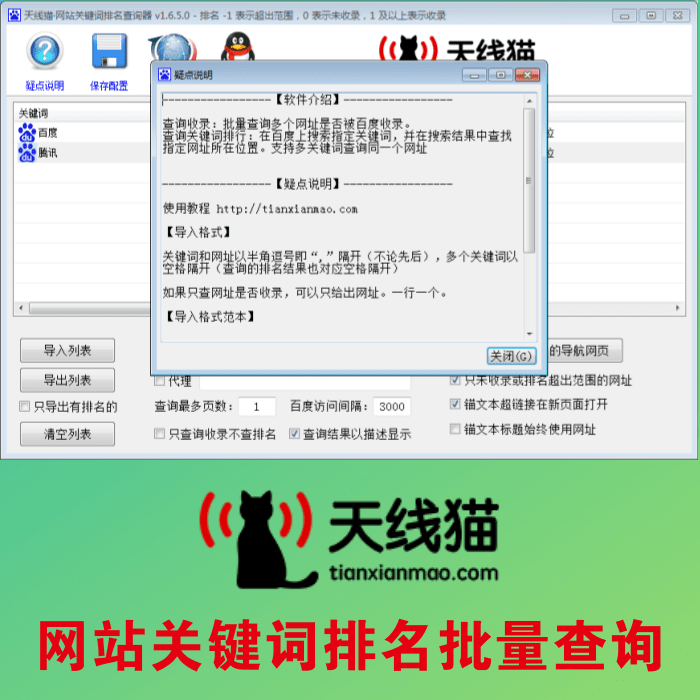

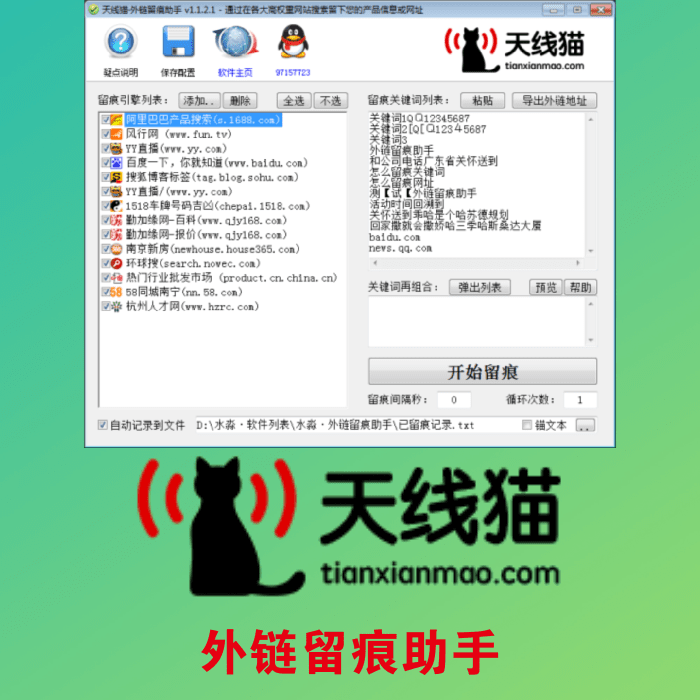

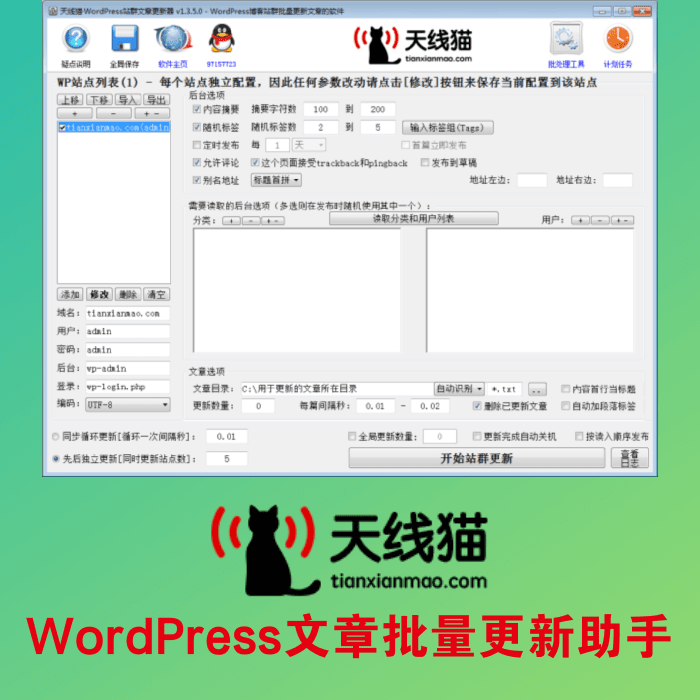

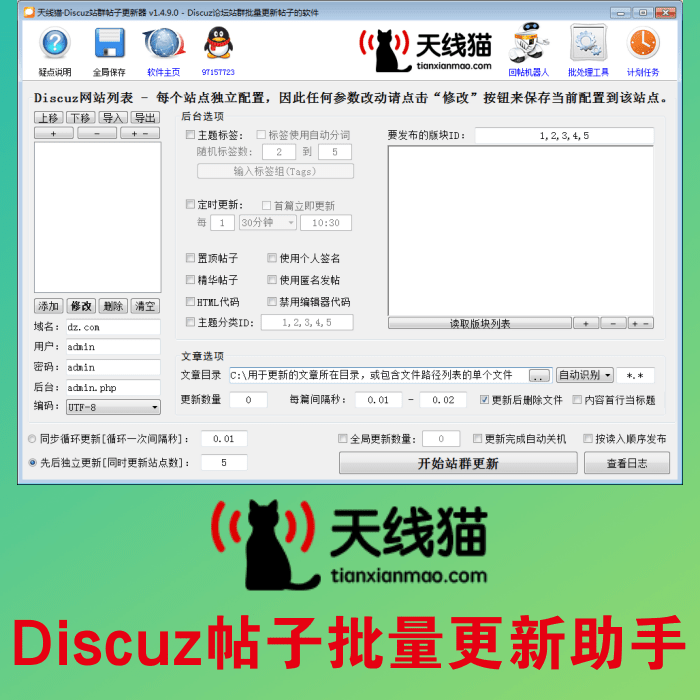

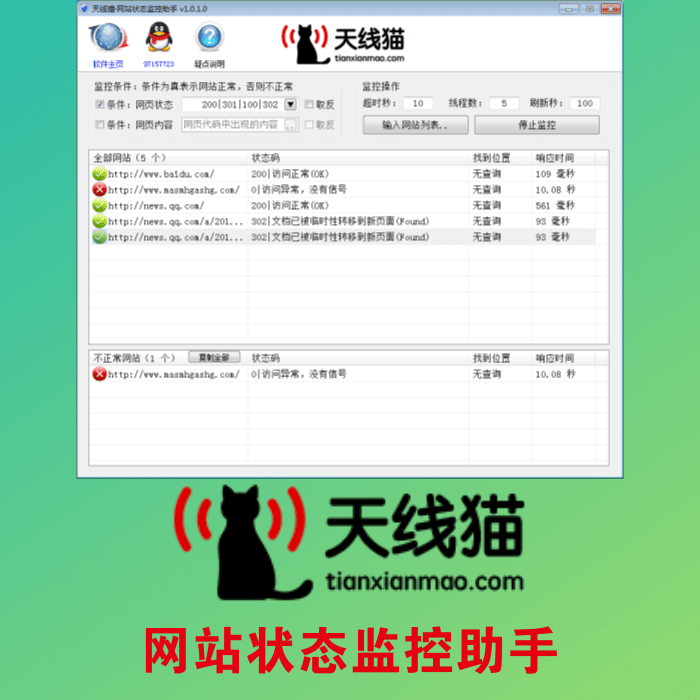

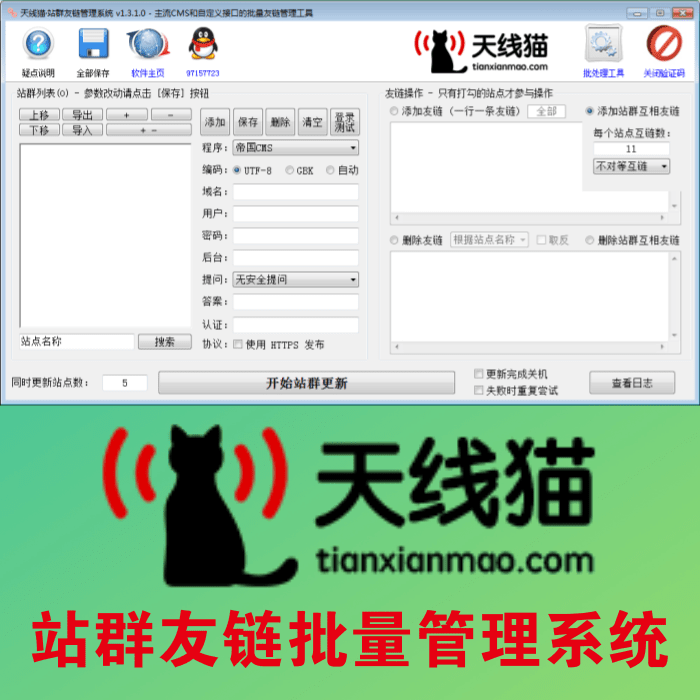

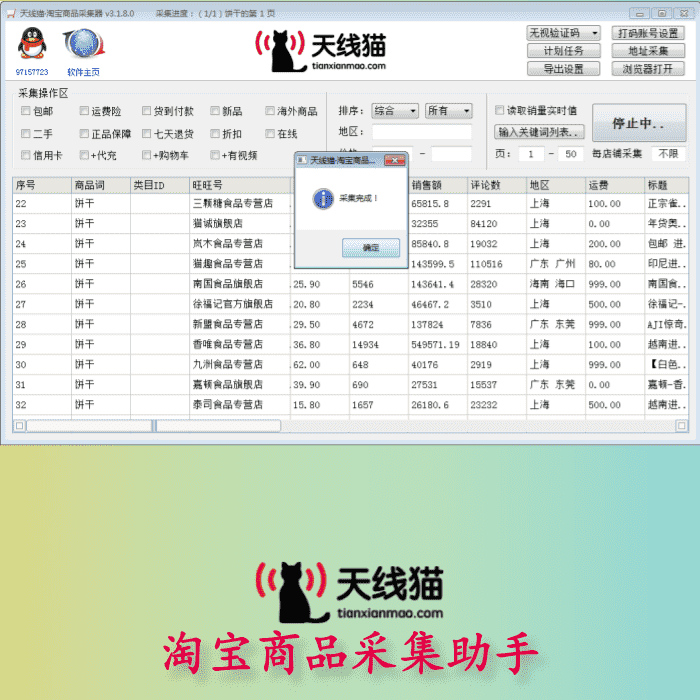

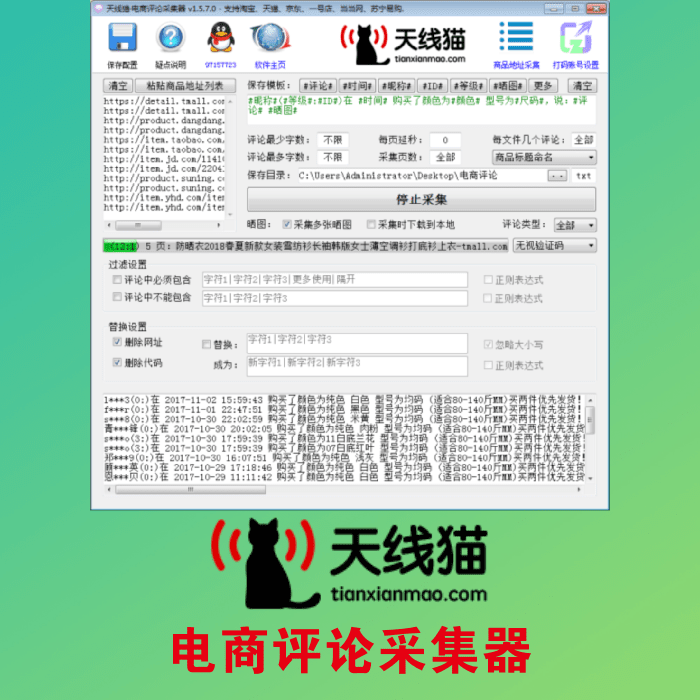

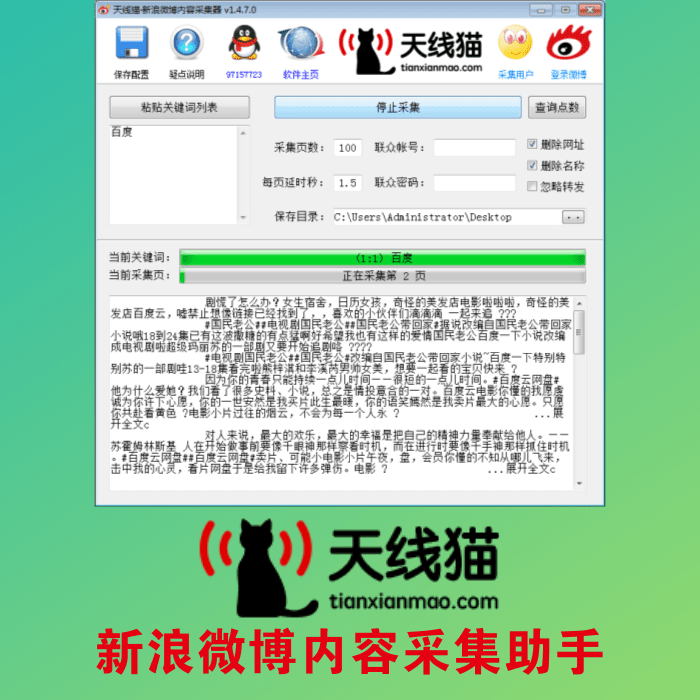

解放双手,效率倍增!天线猫软件,您的推广营销好帮手,本网站专注研发SEO优化软件、工作效率类软件、批量采集发布软件、其他网络软件等。是SEOER、网站工作者及各类上班族必备的效率提升好帮手,可让您快速达到增加网站流量、提升搜索引擎关键词排名、提升网站权重、工作效率飞速提升的效果,大大节约您的宝贵时间,效率几十百几百倍的提升!各软件均支持免费试用,下载地址请点这里 [天线猫软件下载]