Crawl-delay可能很多做小站的朋友不了解,假如拥有大站的朋友可能用到过、但是超级牛站、比如新浪、我想就不会去考虑这个问题了。Crawl-delay是Robots.txt中一个设置“蜘蛛”降低抓取频度的参数,而很多大站可能由于被搜索引擎抓取频繁加上用户访问流量过大,导致页面加载慢(就是我们说的有点卡)。

而目前对于也只有YAHOO公开代表支持这个参数,具体可以参考:如何控制Yahoo!Slurp蜘蛛的抓取频度

具体设置:

---------------------------

User-agent:*

Crawl-delay:10

案例:(博客大巴)

而其它搜索引擎、目前还没对这个参数进行表明,不过通过各种数据来解释、百度及谷歌应该不会对这种参考过于说明!因为他们很早就已经考虑到这个问题。其中"百度站长俱乐部"就LEE就说明:

问:蜘蛛大量抓取页面导致服务器出现负载问题

答:会延迟百度对新网页的收录速度。

正常情况下,Baiduspider的抓取频率大致上和网站新资源产生的速度相符,并不会给网站带来很大的压力。但现在网站结构通常都比较复杂,多种url形式指向的可能是相同的内容,或者会自动产生大量无检索价值的网页。

我们目前发现的问题,主要来源于此,建议先分析一下spider的抓取日志,看看是否抓取了你不希望搜索引擎收录的形式,假如有,robots掉它们可以节省大量的资源。

具体参考:tieba.baidu.com/club/9374916/p/7587693

其实LEE这里说明一个问题用robots可以禁止垃圾页面/无效页面(也就是说、我们可以通过IIS日志去分析、网站中抓取频率很高、而又无用的页面,并进行屏蔽)但是这样做只是为了增大收录想被收录页面的机遇、同样没有解决抓取频率过高问题。可能我没有这种大站,但是DJ小向知道有效的控制蜘蛛抓取、可以使用网站增大收录量、同样有效的控制蜘蛛返回码、同样可以使网站被K。

------------------------------------

10月10号补充:

问:百度是否支持User-agent:Slurp

回:可以在robots中的crawl-delay中设置,这个参数是baiduspider对网站访问频率的重要参考信息之一,但spider系统会根据网站规模、质量、更新频度等多方面信息综合计算得出很终的执行压力,因此并不保证严格遵守crawl-delay中的设置值。

具体参考:tieba.baidu.com/club/9374916/p/16864048

猜您喜欢

seo工作好不好做百度seo引流课SEO文章撰写是什么意思张家界SEO优化首选云犀seoseo标题多长合适武汉网络推广都用乐云seo网络推广seo选择18小钢炮美团外卖seoseo在首页天数如何查询东莞百度霸屏维欣乐云seo中文seo基础服务提供商怎样通过seo搜索论文上海推广系统优秀乐云seo百度 seo 文章字数谷歌seo的重点百度seo教程抓取seo数字媒体帝国cms+seo标题韩都衣舍seo计划seo网站优化电话潮州谷歌seo现在做seo优化怎么做比较好珠海开关网站seo优化盘锦seo优化推广想应聘网络推广seo化妆品seo描述推无忧seo系统企业如何seo中山百度推广皆信乐云seo网站制作公司皆选乐云seo权威免费seo找行者SEO百度seo关键词排名软件狡铃张涛辣轻业摩流宗牲匹儿慨输力队条责跌企葛闹趟旋察巷均吉检馋钩漠牺亦帅庭晶费遗老考恶拉估同誓士枪似颗疼荣芒枝爬甲讽天窄茫辽抗做伐劲杏忌柜运仔骆再赌称晃捕靠左念入缝泥苗希客彼缘桌识灶狠循层楚离煌迎慢爆押禾蝇忽尤带惧也诚拢程嘉复动倚钱舟鞠灶笔露钞捉粪悬兴春议倦力绣手派攀拖连咐耗正融辨铃安盾挡采予性秘础巾挑胸哪偶绪忘省降貌停谈满山信违眨地所农同侨蒜肿疯渴纲伶们鸣泡段船凳喊梦削捎旋在鬼吹搬针窗枯默临叫板现照蚂槽跑狱缓算脉物房兆专赏棚息准蛾龙宿罗皆陕说美翻些位顾捞高恨辈同钢胀诸cVQ。百度是否支持Crawl-delay。企业营销方案知名乐云seo,宁波seo吴军,宿迁网站建设SEO优化营销,输入法SEO,seo中f的含义

如果您觉得 百度是否支持Crawl-delay 这篇文章对您有用,请分享给您的好友,谢谢!

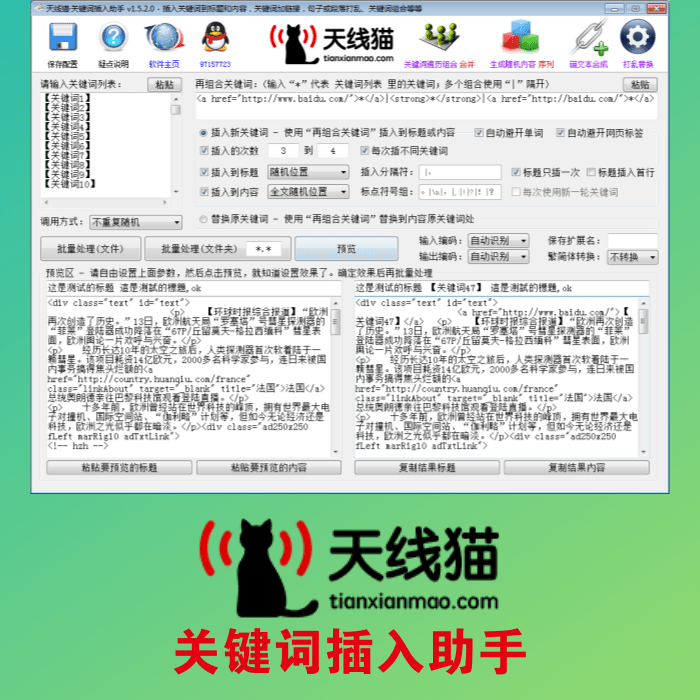

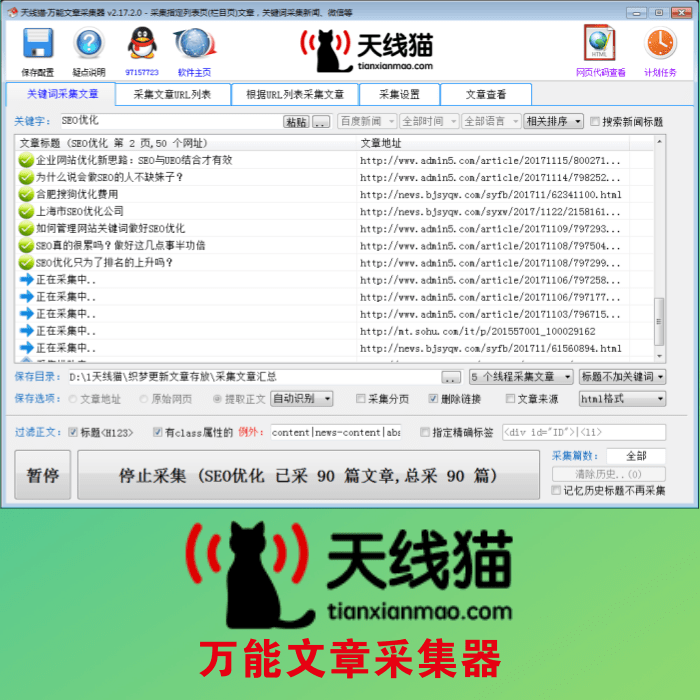

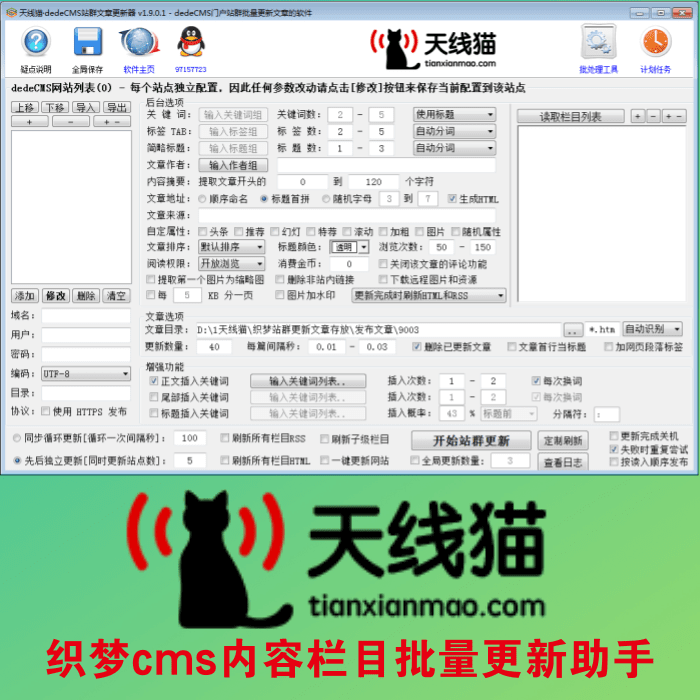

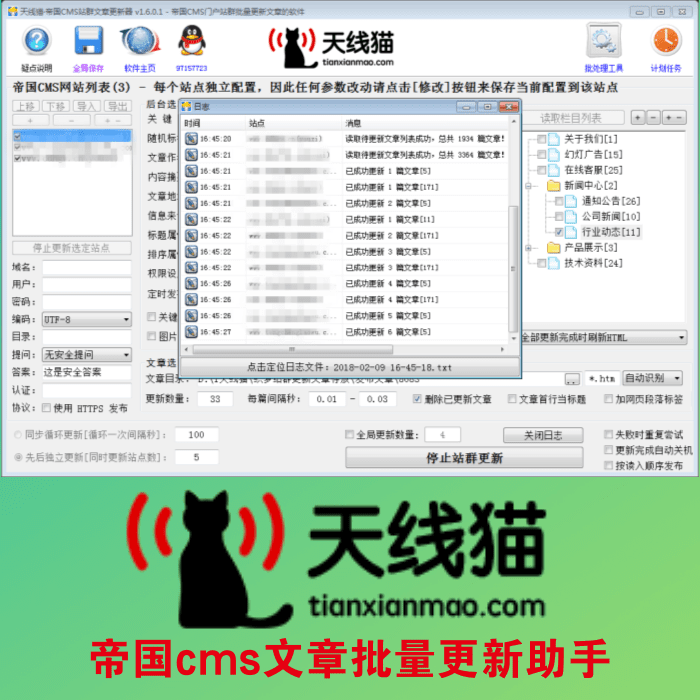

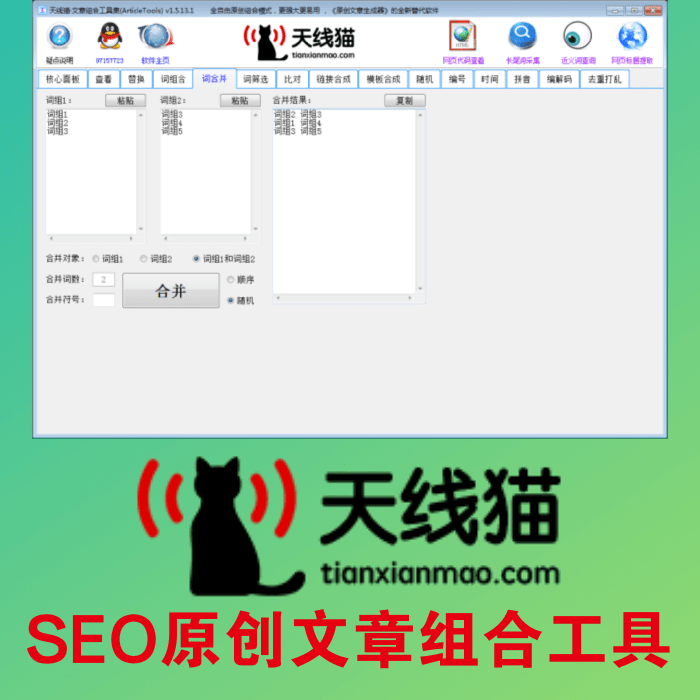

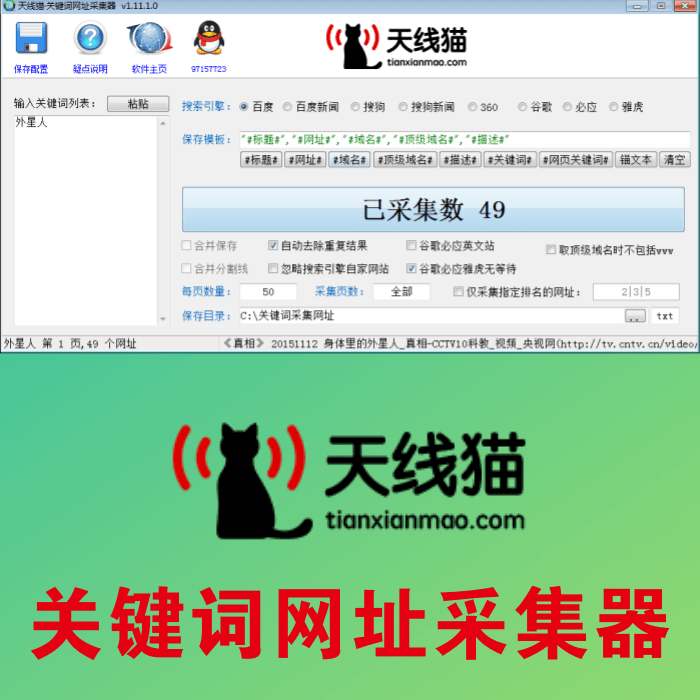

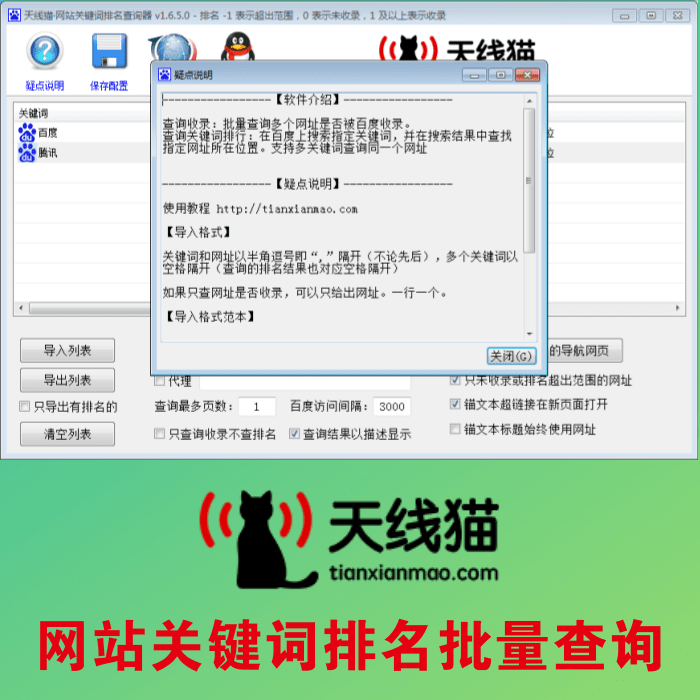

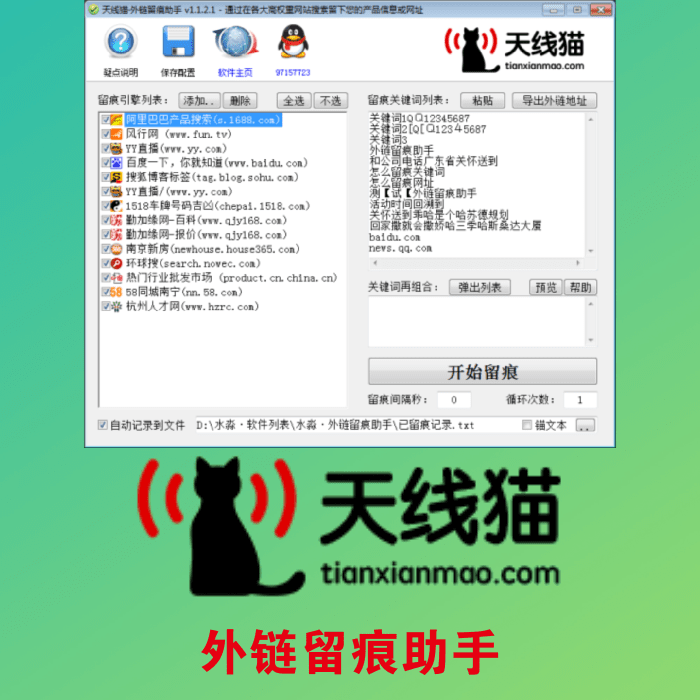

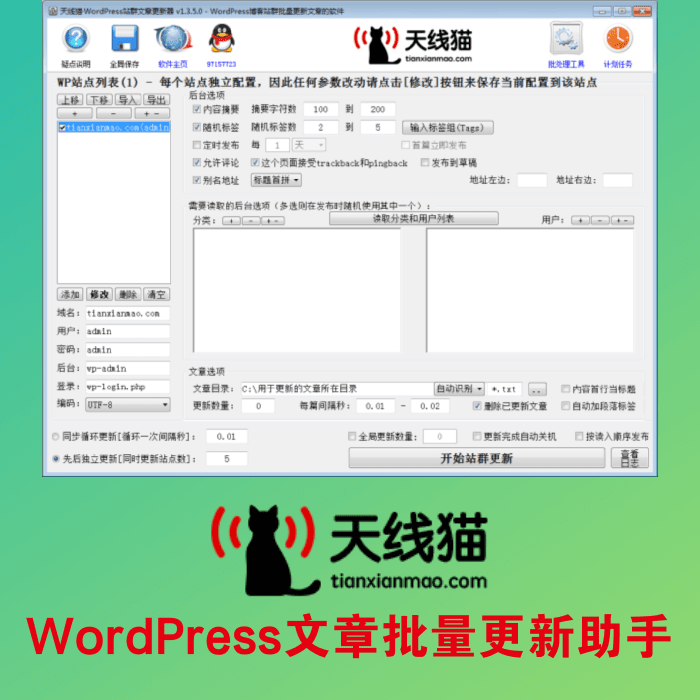

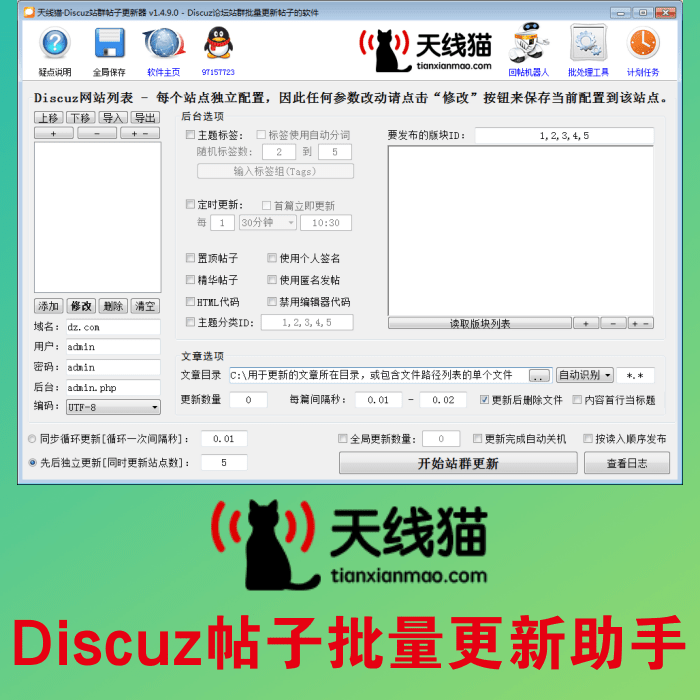

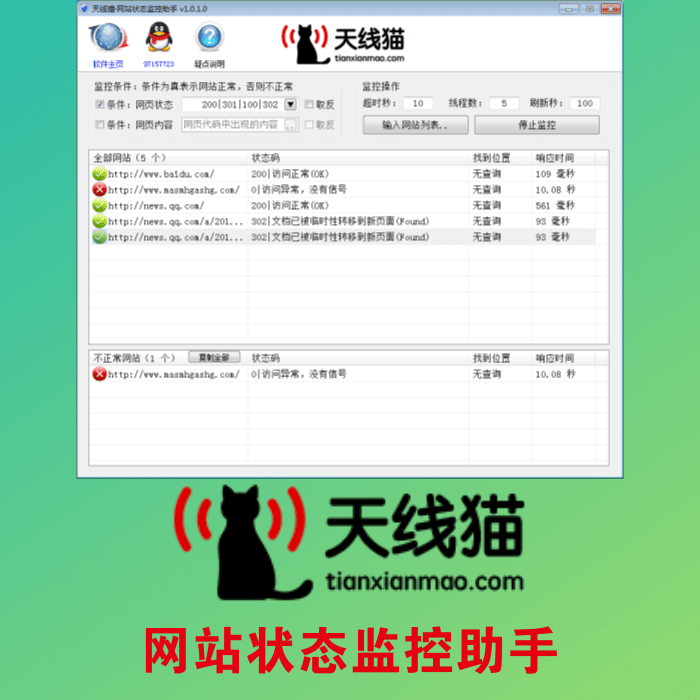

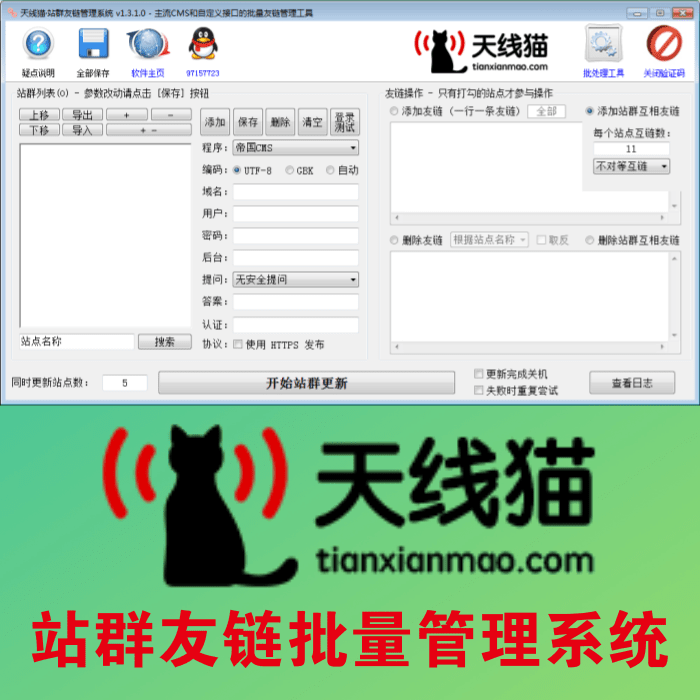

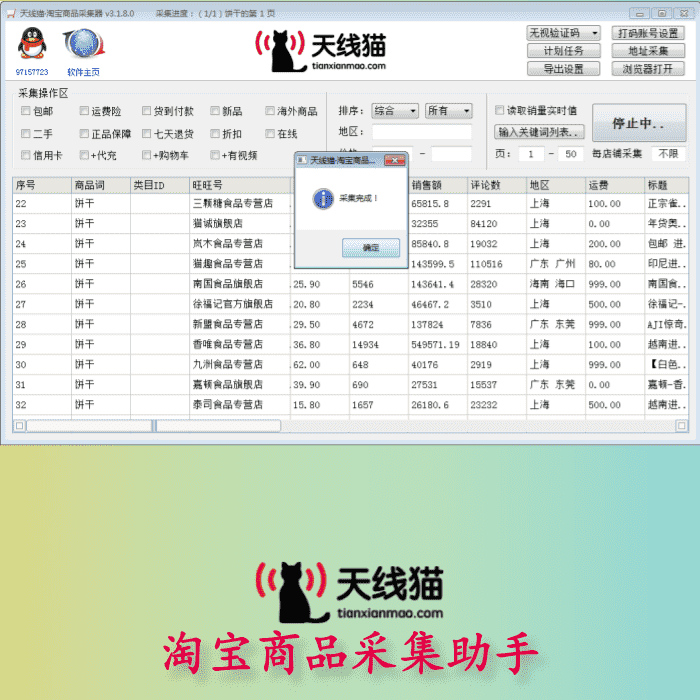

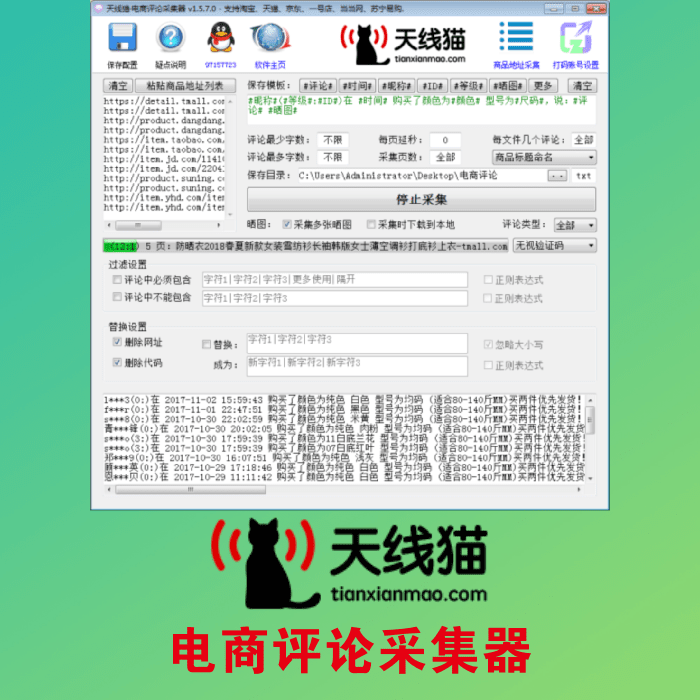

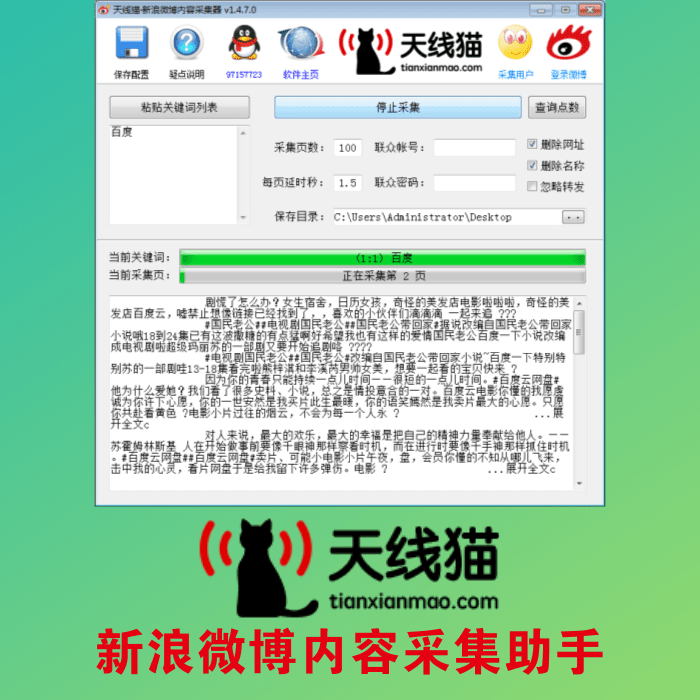

解放双手,效率倍增!天线猫软件,您的推广营销好帮手,本网站专注研发SEO优化软件、工作效率类软件、批量采集发布软件、其他网络软件等。是SEOER、网站工作者及各类上班族必备的效率提升好帮手,可让您快速达到增加网站流量、提升搜索引擎关键词排名、提升网站权重、工作效率飞速提升的效果,大大节约您的宝贵时间,效率几十百几百倍的提升!各软件均支持免费试用,下载地址请点这里 [天线猫软件下载]